easy-llm-cli的安装和使用

什么是easy-llm-cli

先说下Gemini Cli,它是谷歌开发的一款开源 AI Agent 命令行工具,项目地址如下:

https://github.com/google-gemini/gemini-cli

是目前同类开源 Agent 产品中,最热门的工具。

easy-llm-cli是对开源 Gemini Cli做了一个二次改造,可以支持运行任意大模型,包括本地模型, 还支持直接将它引入我们自己项目或者业务流程。

easy-llm-cli官方教程视频:

https://www.bilibili.com/video/BV1mQghz5EJe/

easy-llm-cli源码(不需要下载,命令行安装即可):

https://github.com/ConardLi/easy-llm-cli/tree/main

easy-llm-cli中文文档:

https://github.com/ConardLi/easy-llm-cli/blob/main/README.zh-CN.md

安装easy-llm-cli

需要先安装node.js,node.js版本20以上,node.js下载地址

Node.js — Download Node.js®

在CMD命令行窗口执行下面命令,安装easy-llm-cli

npm install -g easy-llm-cli

安装完成后,会自动显示认证页面。

因为网络问题,很麻烦,所以选择了国内的模型提供商,当然,也可以用自己的本地模型。

下面以kimi的k2模型为例,演示配置过程。

在命令行窗口中,执行以下命令,修改环境变量,自定义我们的模型配置:

set USE_CUSTOM_LLM=true

set CUSTOM_LLM_PROVIDER=moonshot

set CUSTOM_LLM_API_KEY=sk-xxxxxxxx

set CUSTOM_LLM_ENDPOINT=https://api.moonshot.cn/v1

set CUSTOM_LLM_MODEL_NAME=kimi-k2-0711-preview

CUSTOM_LLM_API_KEY需要去官方获取,访问链接:

Moonshot AI 开放平台 - Kimi 大模型 API 服务

配置参数说明:

# 启用自定义 LLM 支持

USE_CUSTOM_LLM=true

CUSTOM_LLM_API_KEY="your-api-key" # 你的 LLM 提供商 API 密钥

CUSTOM_LLM_ENDPOINT="https://api.your-llm-provider.com/v1" # API 端点

CUSTOM_LLM_MODEL_NAME="your-model-name" # 模型名称# 可选参数

CUSTOM_LLM_TEMPERATURE=0.7 # 温度参数(默认值:0)

CUSTOM_LLM_MAX_TOKENS=8192 # 最大令牌数(默认值:8192)

CUSTOM_LLM_TOP_P=1 # Top P 参数(默认值:1)

注意,windows中用set方式配置的环境变量 ,只是在当前cmd窗口有效,如果要持久化,需要配置系统环境变量 。

配置完成,输入命令启动

elc

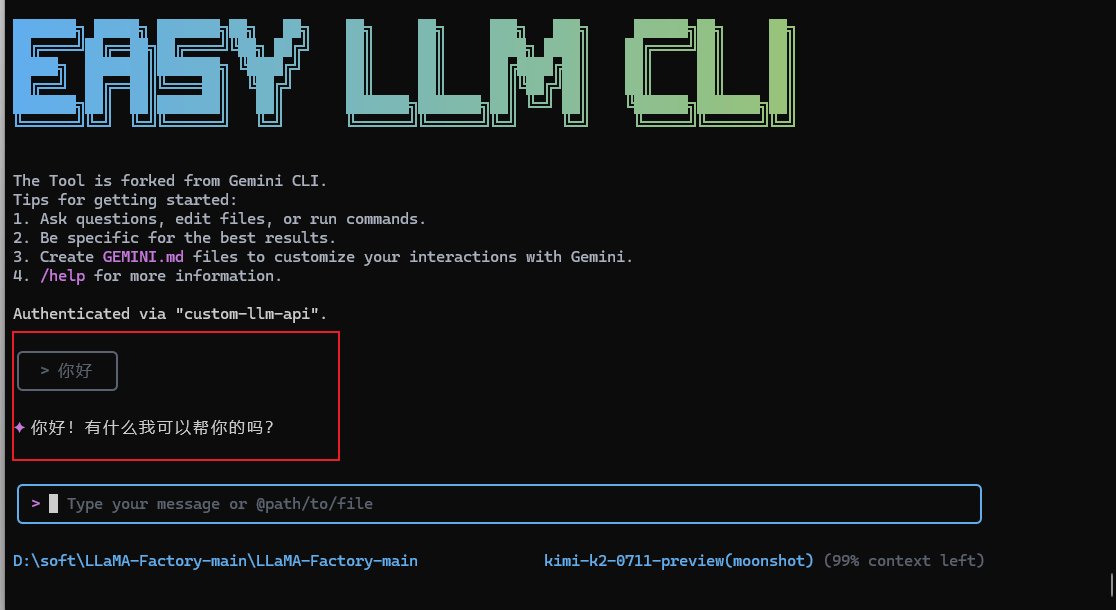

启动后,显示如下信息

测试效果