苹果的机器学习框架将支持英伟达的CUDA平台

苹果专为Apple Silicon设计的MLX机器学习框架即将迎来CUDA后端支持,这意义重大。原因如下。

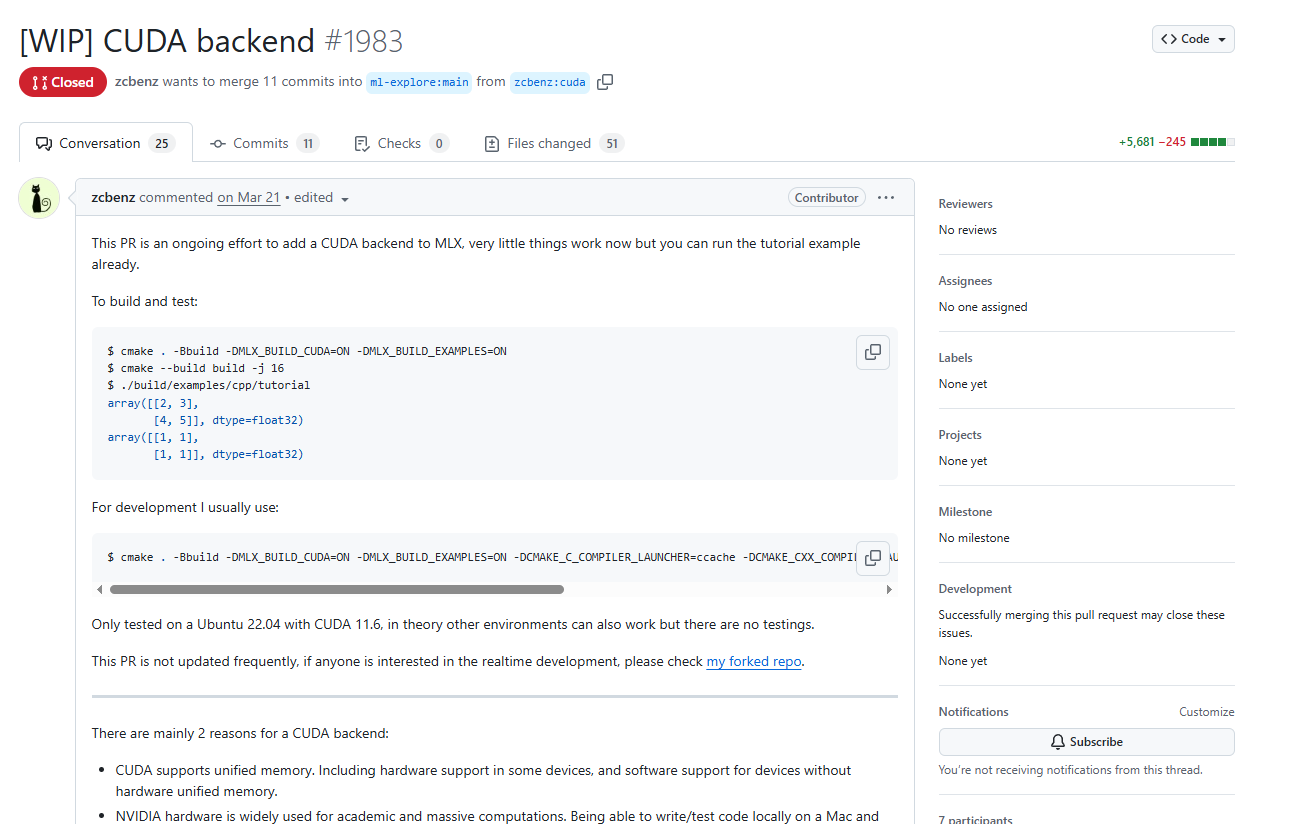

这项开发工作由GitHub开发者@zcbenz主导(据AppleInsider报道),他于数月前开始构建CUDA支持的原型。此后他将项目拆分为多个模块,逐步将其合并至苹果MLX框架的主分支。

虽然该后端仍在开发中,但矩阵乘法、softmax函数、归约运算、排序和索引等核心操作已实现支持并通过测试。

等等,什么是CUDA?

简单来说,CUDA(Compute Unified Device Architecture)就是英伟达硬件的"Metal":这是该公司专为其GPU打造的计算平台,旨在充分发挥其硬件性能以完成高性能并行计算任务。

对多数人而言,CUDA是在英伟达GPU上运行机器学习任务的标准方式,它贯穿整个机器学习生态圈,从学术研究到商业部署无不涉及。即便是机器学习领域之外也耳熟能详的PyTorch和TensorFlow等框架,都依赖CUDA来实现GPU加速。

为何苹果MLX框架现在要支持CUDA?

MLX最初是针对苹果芯片和Metal框架优化的,但新增CUDA后端改变了这一局面。现在研究人员和工程师可以在Mac上借助MLX本地调试基于CUDA的模型原型,然后部署在仍主导机器学习训练任务的NVIDIA大型GPU集群上。

不过目前仍存在若干限制,多数功能还在开发中。例如并非所有MLX算子都已实现,AMD显卡支持更是尚需时日。

但MLX与NVIDIA GPU的深度结合,确实为快速测试、实验和研究场景打开了新可能——这恰恰是AI开发者最期待听到的消息。