超长视频生成新突破!LongVie框架问世,创作不再受时长限制

超长视频生成新突破!LongVie框架问世,创作不再受时长限制

文章来源:Poixe AI

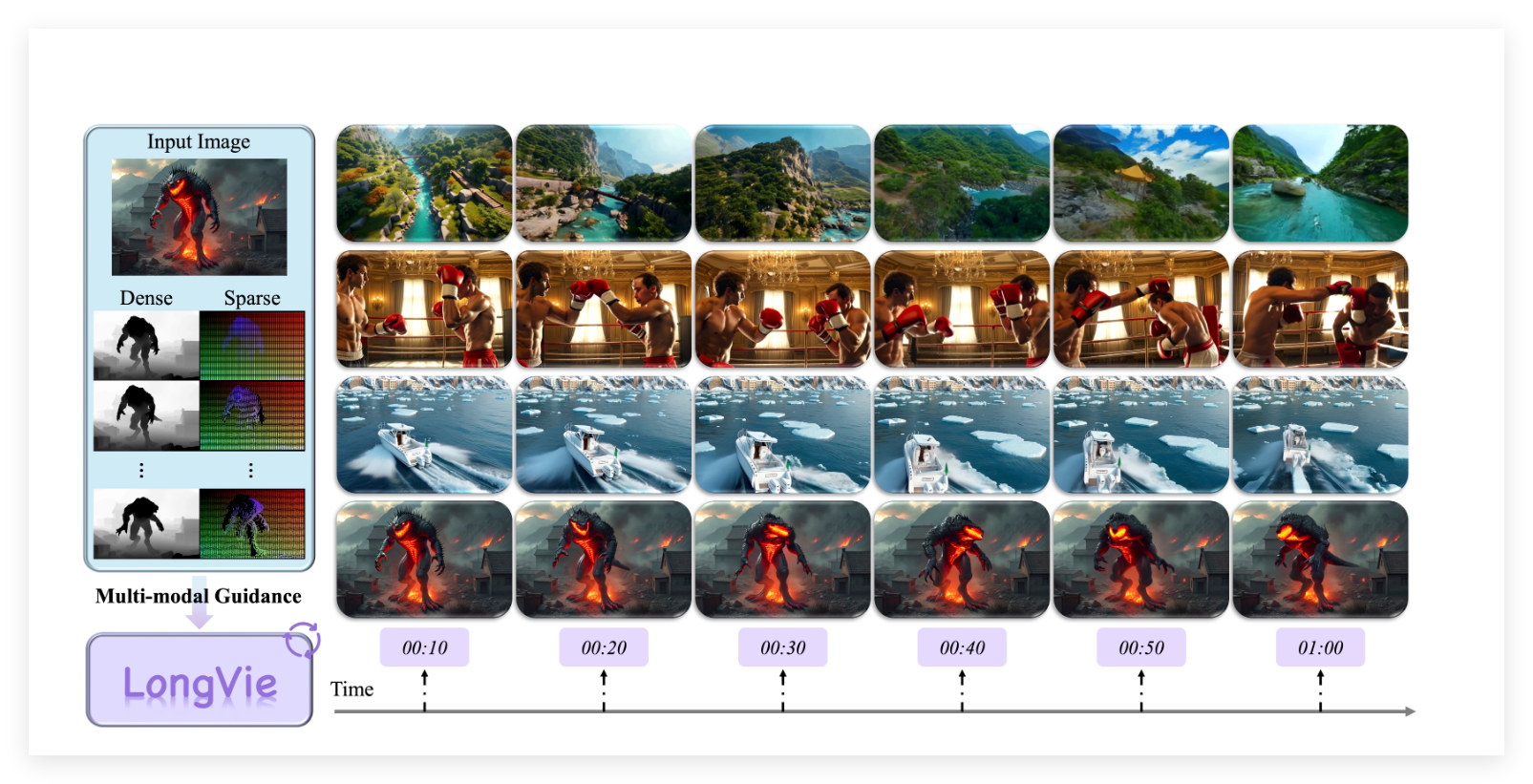

在AI技术飞速发展的当下,视频生成领域取得了令人瞩目的进步,尤其是在短视频创作方面。然而,当视频时长超过一分钟时,保持画质、风格和内容的高度一致性,仍然是一个巨大的技术挑战。

为攻克这一难题,上海人工智能实验室联合南京大学、复旦大学、南洋理工大学S-Lab以及英伟达等顶尖机构,共同推出了革命性的 LongVie 框架。这款框架旨在系统性解决超长视频生成中的核心问题,为创作者们开启一个无界限的创作新时代。

核心挑战:时序不一致与视觉退化

传统视频生成模型在处理长视频时,主要面临两大核心挑战:

- 时序不一致: 画面细节与内容在不同片段间缺乏连贯性,导致视频整体感觉不自然。

- 视觉退化: 随着视频时长的增加,画面颜色和清晰度会逐渐下降,影响最终的视觉质量。

LongVie 框架正是为了解决这些痛点而生。

LongVie框架:从根源解决问题

为了确保超长视频的连贯性与高质量,LongVie 框架从“控制信号”和“初始噪声”两个关键方面入手,提出了创新的解决方案:

- 全局归一化控制信号:

- 创新点: 传统的生成模型只在单个片段内进行归一化。

- LongVie 策略: 统一整个视频段的控制信号(如深度图、关键点等),从而显著提升跨片段的连贯性和流畅性。

- 统一噪声初始化:

- 创新点: 确保视频的各个片段共享相同的初始噪声。

- LongVie 策略: 从源头上减少不同片段之间的视觉漂移,保证整体风格和画质的一致性。

此外,在解决视觉退化问题上,LongVie 采用了多模态精细控制方法,结合了密集控制信号和稀疏控制信号,并引入了“退化感知训练策略”,确保模型在处理长视频时,能够持续保持高画质和细节的稳定性。

行业新标杆:LongVGenBench数据集与SOTA性能

为了推动整个领域的进步,LongVie 团队还推出了 LongVGenBench,这是首个专为可控超长视频生成设计的基准数据集。该数据集包含100个超过1分钟的高分辨率视频,为研究人员提供了统一的评测标准。

根据定量指标和用户评测结果,LongVie 在多个评估维度上均超越了现有技术,赢得了用户的高度认可,达到了 SOTA(State-of-the-Art,最先进技术) 水平。

总结:

LongVie 框架的问世,无疑是AI视频生成领域的一个重要里程碑。它系统性地解决了超长视频生成中的核心挑战,为创作者们提供了前所未有的自由度和控制力。随着这项技术的普及,我们有理由相信,AI生成视频的未来将不再受时长限制,创意将能够真正无界限地实现。

项目地址: https://vchitect.github.io/LongVie-project/