【光学神经网络与人工智能应用专题】

光学神经网络的基本概念

光学神经网络(Optical Neural Networks, ONNs)是一种利用光学元件(如透镜、激光器、空间光调制器等)实现神经网络计算的新型架构。其核心优势在于高速并行计算和低能耗,尤其在矩阵乘法等线性运算中表现突出。

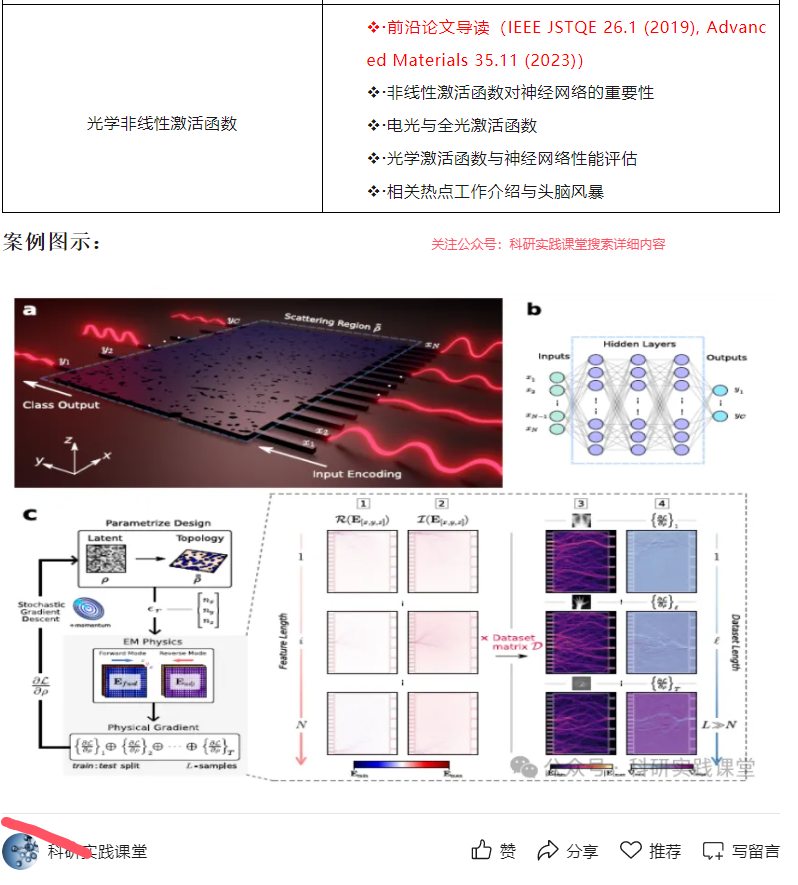

- 工作原理:通过光波的干涉、衍射和调制实现线性变换,非线性激活函数通常通过电光混合设计完成。

- 关键组件:空间光调制器(SLM)、光电探测器、激光源和光子集成电路(PIC)。

光学神经网络的优势

- 高速度:光速传播特性使其计算延迟极低,适合实时处理任务(如视频分析)。

- 低功耗:光的并行性减少晶体管开关能耗,适合边缘计算场景。

- 抗电磁干扰:光信号不受传统电子噪声影响,可靠性更高。

人工智能中的应用场景

- 图像识别:利用光学卷积加速特征提取,例如人脸检测或医学影像分析。

- 自然语言处理:光学矩阵乘法加速Transformer模型的注意力机制运算。

- 量子计算接口:作为经典计算与量子比特之间的桥梁,优化混合算法。

当前技术挑战

- 非线性实现困难:光学系统缺乏天然非线性元件,需依赖电光混合设计。

- 集成度限制:大规模光子集成电路(PIC)的制造工艺尚不成熟。

- 算法适配:传统神经网络框架(如PyTorch)需重新设计以适应光学硬件特性。

最新研究进展

- 可编程ONN芯片:MIT团队开发了基于硅光子的可重构光学神经网络芯片,支持动态权重调整。

- 全光神经网络:加州理工学院实验验证了全光非线性激活方案,突破电光转换瓶颈。

- 商业化尝试:初创公司Lightmatter推出光学加速器“Envise”,专为AI推理任务优化。

未来发展方向

- 混合架构:光电协同设计结合电子计算的灵活性和光学计算的高效性。

- 材料创新:二维材料(如石墨烯)提升光调制效率与集成密度。

- 标准化工具链:开发光学神经网络专用编译器(如Neurophox)和仿真平台。

代码示例(光学矩阵乘法模拟):

import numpy as np

def optical_matmul(A, B): # 模拟光学干涉实现的矩阵乘法 return np.abs(np.fft.ifft2(np.fft.fft2(A) * np.fft.fft2(B)))

数学公式(衍射计算):

[

U(x,y) = \frac{e^{ikz}}{i\lambda z} \iint_{-\infty}^{\infty} U_0(\xi, \eta) e{\frac{ik}{2z}[(x-\xi)2 + (y-\eta)^2]} d\xi d\eta

]

参考资料

- 期刊论文:Nature Photonics 2023年关于可扩展光学神经网络的综述。

- 会议报告:NeurIPS 2022研讨会“光学AI硬件”专题讨论。