跨平台、低延迟、可嵌入:实时音视频技术在 AI 控制系统中的进化之路

引言:面向未来的实时音视频基座

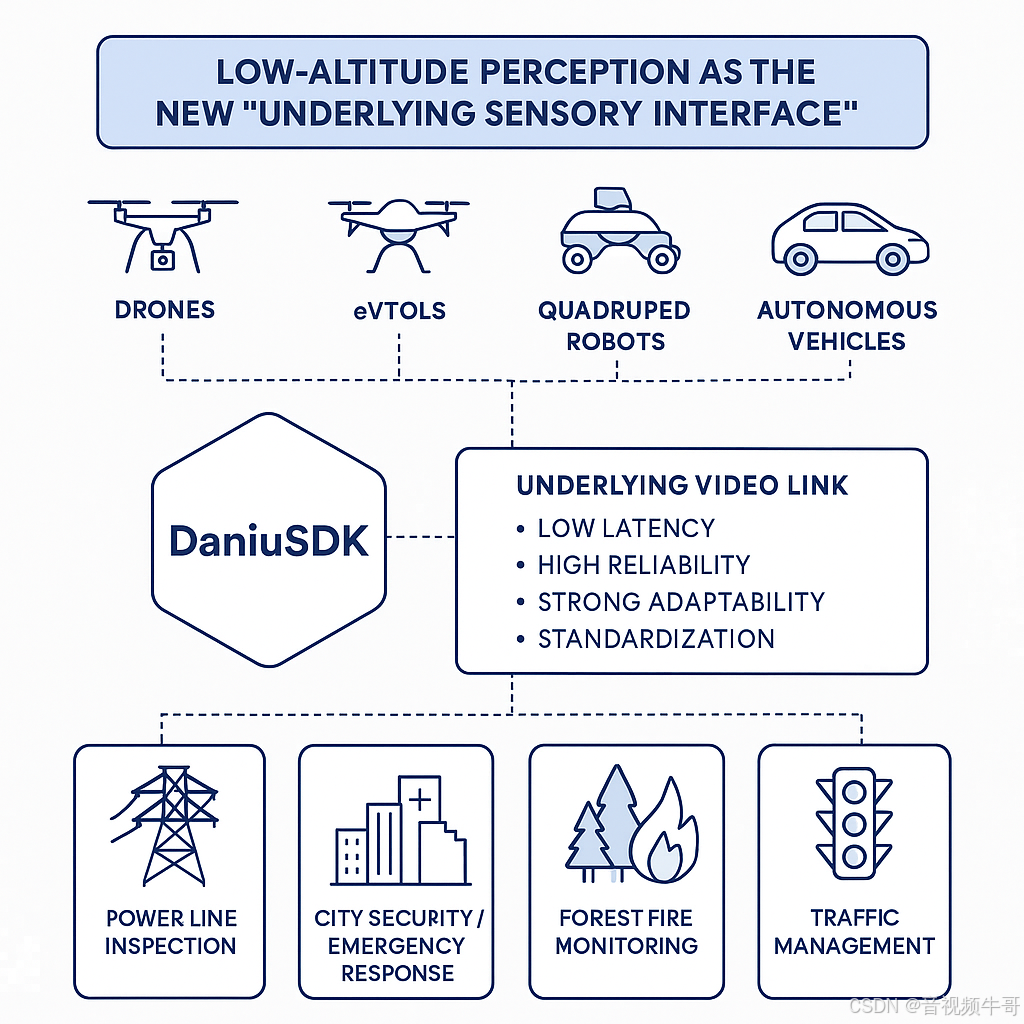

在万物互联与智能化加速落地的时代,实时音视频技术早已不再只是社交娱乐的附属功能,而是智慧城市、应急指挥、远程操控、工业智造、教育培训、安防监控等系统的“神经中枢”。一条高性能、可控、低延迟的视频链路,正在成为 AI 决策、物联网感知、跨地域协作的核心基础设施。

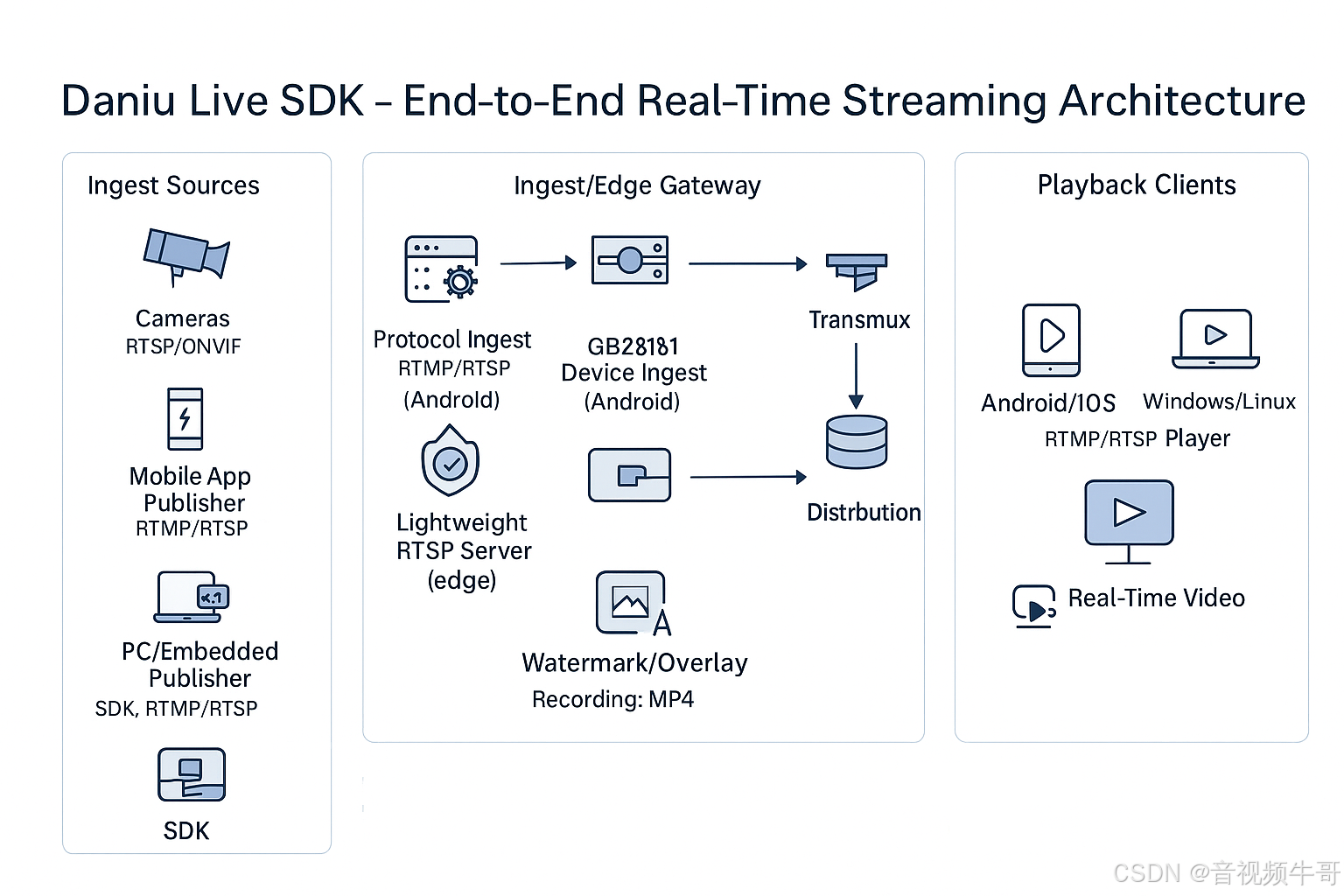

大牛直播 SDK(SmartMediaKit)正是基于这样的技术背景诞生——它不仅是一套跨平台、超低延迟、高可靠性的实时音视频解决方案,更是一个能够灵活适配不同业务场景的模块化技术底座。无论是毫秒级的低延迟视频推拉流、多路视频并发与转发,还是与 AI 推理引擎、边缘计算节点的无缝衔接,SmartMediaKit 都提供了从采集、编码、传输、播放、转发到录像、分析的全链路能力。

与传统的单一功能 SDK 不同,SmartMediaKit 将推流、拉流、存储、互动、转发、国标对接等核心能力模块化,每个模块既可独立运行,又可自由组合,从而帮助开发团队快速构建高度定制化、可持续演进的音视频系统架构。这种“积木式”的设计理念,不仅缩短了集成周期,也在延迟控制、弱网适配、跨平台兼容等方面,提供了超越行业平均水平的性能保障。

在复杂多变的应用环境中,无论是无人机的低空巡检、港口的自动化吊装,还是多终端的远程协作,SmartMediaKit 都能让视频链路稳定、高效地运行,成为面向未来的实时音视频基座。

一、技术演进:从单点功能到模块化底座

在实时音视频领域的早期阶段,应用需求相对单一,开发者更多是为了满足一个“能看见/能听见”的基本目标,采用固定协议(RTMP、RTSP 等)和传统流媒体服务架构,围绕单一功能进行开发。那时,SDK 的形态大多是单点工具化的:一个推流库只能推流,一个播放器只能播放,互不兼容,扩展性有限。

然而,随着业务场景的快速扩展与多样化,单点式的技术架构暴露出明显瓶颈:

-

协议多样化 → 不同终端、不同网络环境需要支持 RTSP、RTMP、HTTP-FLV等多协议适配。

-

功能链路复杂化 → 单纯的推/拉流功能,无法满足实时转发、存储回放、互动控制、AI 分析等链路组合需求。

-

跨平台要求提高 → 从 Windows、Linux 到 Android、iOS,再到 Unity、嵌入式硬件,音视频能力需要一次开发、多端运行。

-

延迟与稳定性挑战 → 无人机操控、远程医疗、工业智造等场景,对毫秒级延迟和链路稳定性提出极高要求。

大牛直播SDK(SmartMediaKit)的技术演进,正是基于这些行业痛点进行迭代:

-

第一阶段:功能聚焦期

-

以稳定的 RTMP 推流与 RTSP 播放为核心,提供可直接集成的 API,解决基础推拉流需求。

-

重点优化低延迟播放与弱网适配,让 SDK 在安防与直播行业中快速落地。

-

-

第二阶段:多协议融合期

-

在保持低延迟特性的前提下,扩展支持 HTTP-FLV等协议。

-

引入轻量级 RTSP 服务模块(无需独立流媒体服务器),降低部署与运维成本。

-

-

第三阶段:模块化组合期

-

将推流、播放、转发、录像、互动、国标 GB28181 接入等能力拆分为独立模块。

-

模块可按需加载,支持跨平台复用,开发者可以“像搭积木一样”构建视频链路。

-

-

第四阶段:智能融合期

-

面向 AI 推理、边缘计算、工业控制等新兴需求,优化 SDK 与 AI 引擎的耦合接口。

-

支持直接在链路中进行帧级回调、数据分流,实现采集 → AI 分析 → 决策执行的闭环。

-

这种演进不仅是功能的堆叠,更是一种架构哲学的变化——从单点功能的“工具库”,到可支撑多业务、多协议、多平台的实时音视频基座,为未来 AI 与物联网融合下的超低延迟场景打下了坚实基础。

二、核心能力矩阵:从推拉流到全链路协作

在音视频行业的发展历程中,推流与拉流曾是最核心、也是最基础的两大能力——前者负责将采集到的音视频数据传送出去,后者负责将数据取回并呈现出来。

然而,随着应用场景从单向直播扩展到双向互动、远程操控、AI 推理、数据留存等复合需求,仅靠推拉流已经无法满足系统的完整生命周期管理。

大牛直播SDK(SmartMediaKit)在架构设计上,打破了“推流=生产端、拉流=消费端”的传统界限,将其升级为全链路协作能力矩阵:

1. 推流(Publishing)

-

协议支持:RTMP推送、轻量级RTSP服务

-

特性优化:端到端低延迟(可低至 100~250ms)、弱网断网自动重连、自适应码率

-

部署形态:支持嵌入式 Linux、Android、Windows、iOS 等多端,直接调用 API 即可推送

2. 播放(Playback)

-

协议支持:RTSP、RTMP、HTTP-FLV

-

解码优化:软解 / 硬解智能切换,GPU 加速渲染,支持多路并发

-

延迟模式:普通模式、低延迟模式、超低延迟模式可选,满足监控与互动不同场景

3. 转发(Relay)

-

场景作用:多协议互转(如 RTSP → RTMP)、流分发至云端/边缘节点

-

应用案例:无人机视频回传到指挥中心并同步推送到云端 AI 分析

4. 存储(Recording)

-

支持格式:MP4本地文件切片

-

功能延伸:支持录像路径设置、单个文件大小设置、纯音频纯视频录制、audio转AAC录制等

-

应用场景:安防录像、远程作业回放、AI 训练数据采集

5. 互动(Interactive)

-

功能形式:一对一、一对多实时音视频互动

-

技术保障:双向超低延迟(200ms 以内),适配云端/局域网部署

-

典型应用:远程机械臂操控、应急指挥可视化调度

6. 协议接入(Integration)

-

国标支持:内置 GB28181 模块,直接与公安/安防平台对接

-

数据分流:支持在链路任意位置做帧级数据回调,用于 AI 实时识别与分析

-

跨系统协作:可作为物联网平台、机器人控制系统的视频中枢

这种模块化 + 全链路的能力矩阵,使得大牛直播SDK不仅仅是“播放器”或“推流器”,而是一个可自由拼装的实时音视频底座。

开发者可以根据业务需求,从矩阵中挑选所需模块——例如,在无人机巡检场景中选用 推流 + 转发 + 播放 + AI 分流,在远程会议场景中则选用 推流 + 播放 + 互动,做到功能精确匹配、性能最优组合。

三、典型场景落地:模块组合的最佳实践

大牛直播SDK(SmartMediaKit)的模块化能力矩阵并不是纸面上的设计,而是在大量不同行业的实战落地中逐步打磨出来的。

从智慧城市的实时监控,到无人机的低空作业,再到远程工业操控,这些场景都有一个共性——视频链路是任务执行的“神经中枢”,而链路的延迟、稳定性和可控性,直接决定了任务能否成功完成。

下面,我们通过几个典型的落地场景,来看看模块组合是如何支撑复杂业务需求的。

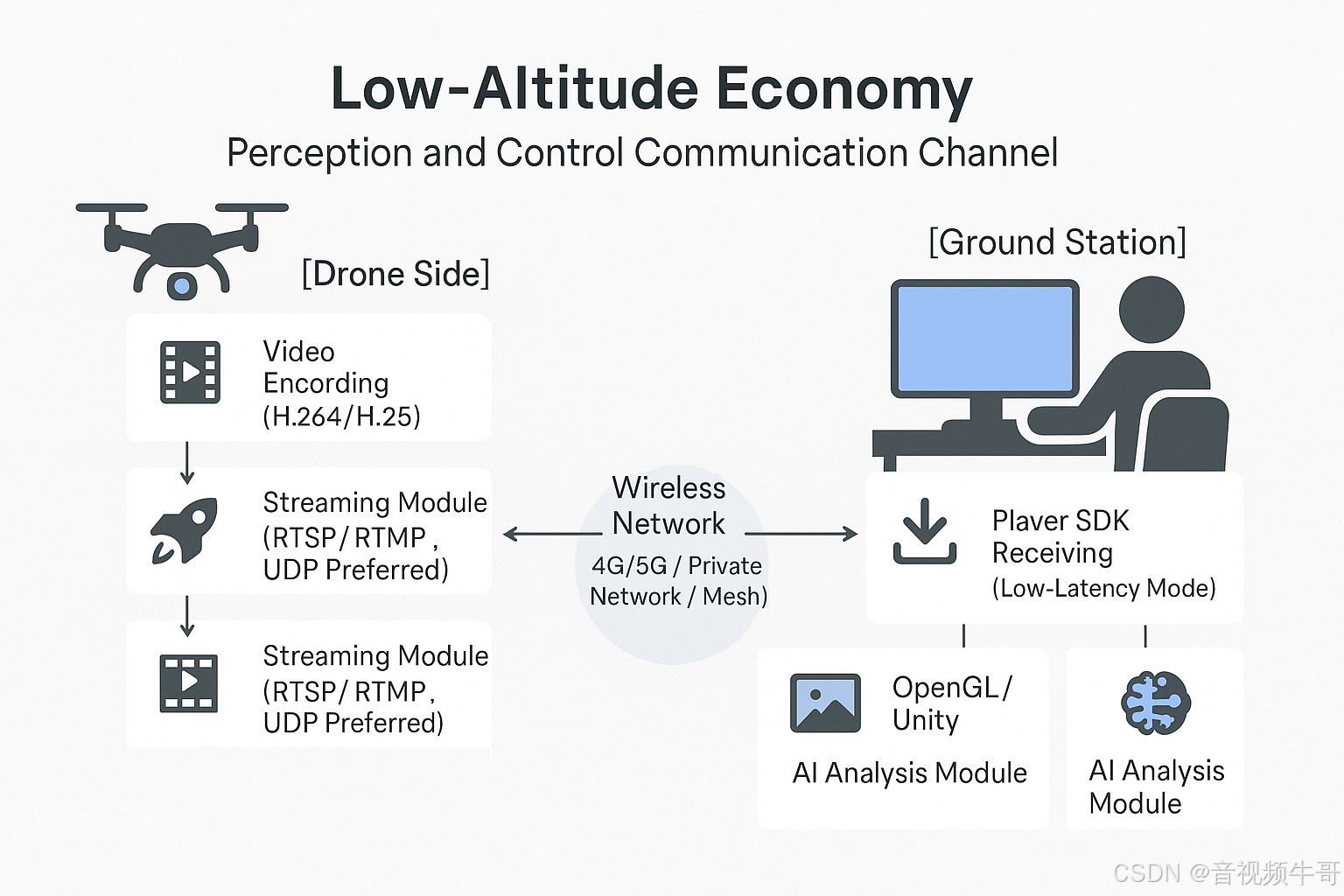

1. 无人机低空巡检

-

运行平台:Linux ARM64(飞控板) + Android(指挥端手持终端)

-

推荐模块组合:

-

RTMP Push SDK(无人机端推流)

-

Lightweight RTSP Service SDK(机载本地视频服务)

-

RTSP Player SDK(指挥端低延迟播放)

-

-

技术亮点:

-

支持多路摄像头并发推流

-

低延迟模式下端到端延迟可稳定在 100~200ms

-

支持边飞边将视频流分流至 AI 模块进行目标识别

-

2. 室内巡逻机器人

-

运行平台:Linux x86_64(机器人主控) + 边缘计算节点

-

推荐模块组合:

-

Lightweight RTSP Service SDK(机器人端本地服务)

-

RTSP Player SDK(边缘计算节点实时拉流)

-

-

技术亮点:

-

本地局域网部署,避免公网延迟

-

AI 模型可实时执行人形检测、路径规划

-

弱网环境下尽量保持画面完整

-

3. 远程机械臂操控

-

运行平台:Windows(操控台) + Linux ARM64(机械臂控制器)

-

推荐模块组合:

-

RTSP Player SDK(操控端接收视频)

-

One-to-One Interactive Module(低延迟双向视频/音频)

-

-

技术亮点:

-

双向视频交互延迟可控制在 200ms 内

-

精密作业下的稳定控制,避免因视频卡顿造成误操作

-

4. 港口自动化集装箱吊装

-

运行平台:Linux x86_64(边缘服务器) + 云端 AI 平台

-

推荐模块组合:

-

RTSP-to-RTMP Relay Module(边缘节点协议转换)

-

RTMP Player SDK(云端接收)

-

-

技术亮点:

-

在边缘节点完成协议封装,减少云端适配压力

-

视频流同步送入 AI 系统,实现吊车路径优化与安全检测

-

5. 矿区巡检车队

-

运行平台:Android(车载终端) + 边缘 AI 服务器

-

推荐模块组合:

-

RTMP Push SDK(车载端推流)

-

RTSP Player SDK(边缘端接收)

-

-

技术亮点:

-

UDP 低延迟模式 + FEC 纠错,确保弱网环境下画面稳定

-

可实时标注 AI 检测结果并回传至车载终端

-

总结:

通过这些案例可以看到,大牛直播SDK的价值并不止于“能推流、能播放”,而在于它用一个统一的技术栈解决了跨平台、低延迟、弱网适配、协议转换等一系列痛点。

开发者不必在多个 SDK 之间切换或维护额外的流媒体服务器,就能完成从采集、传输到分析、控制的全链路闭环。

四、性能优势:为实时与稳定而生

在无人机、机器人、远程机械臂等操控级 AI 系统中,视频链路的延迟、稳定性和可靠性,不仅仅是“体验指标”,而是决定任务安全性与执行成败的核心条件。

基于大牛直播SDK(SmartMediaKit)的低延迟闭环架构,在多年的实战验证中形成了四大核心性能优势。

Android平台RTSP播放器时延测试

Android平台RTMP直播播放器延迟测试

1. 端到端超低延迟

-

常规方案延迟:1~3 秒(公网 RTSP/RTMP + 服务器转发)

-

SmartMediaKit 延迟:10~250ms(低延迟模式下)

-

技术实现要点:

-

采用 UDP 直连 / 自适应 TCP 传输

-

帧级缓存优化与解码直出

-

绕过传统服务器转发,减少中间处理环节

-

价值:

在高压线路巡检、室内跟踪等场景下,AI 识别到障碍物的同时,执行机构(无人机、机器人、机械臂)即可立即响应,避免因延迟导致的失误。

2. 嵌入式部署与跨平台支持

-

支持平台:Windows / Linux(x86_64、ARM64) / Android / iOS / Unity3D

-

形态优势:

-

直接嵌入终端(飞控板、机器人主板、工业控制器等)

-

模块化编译,按需裁剪,减少运行内存占用

-

-

场景意义:

-

无需依赖机房级流媒体服务器

-

终端到终端链路可快速部署,缩短集成周期

-

3. 弱网环境适应性

-

网络挑战:山区、矿区、港口、工厂内部等网络波动大、丢包严重

-

优化策略:

-

FEC 前向纠错

-

动态码率与分辨率自适应

-

丢包重传与抖动缓冲双机制

-

-

效果:

-

在 20% 丢包率下仍可保持画面可用

-

AI 模型接收到的帧连续性大幅提升,决策准确率更高

-

4. 无需额外流媒体服务器

-

传统方案问题:

-

需部署 Nginx-RTMP、SRS、Wowza 等中间服务器

-

增加延迟与维护成本

-

-

SmartMediaKit 优势:

-

端到端直连 / 边缘节点转发

-

模块级支持 RTSP/RTMP Relay,无需额外机房部署

-

-

收益:

-

架构更简单,维护工作量显著降低

-

部署位置更灵活(云端、边缘、终端均可落地)

-

小结

这四大性能优势,让大牛直播SDK不仅能在理想网络环境下表现优异,更能在复杂现场中保持稳定和可用性。对于需要长时间稳定运行的 AI 控制系统,这种技术底座的价值远超表面参数。

五、展望:AI × 视频链路的协同进化

从无人机到巡逻机器人,从远程机械臂到港口自动化吊装,这些案例都在指向一个趋势:

未来的操控类 AI 系统,将从“视频辅助”迈向“视频驱动”。

而低延迟、可控、稳定的视频链路,将成为系统的“神经中枢”,直接影响决策闭环的速度与准确性。

趋势 1:从“人控”到“AI 主导”

-

早期的远程操控系统更多依赖人类操作员做出决策,视频仅作为辅助信息。

-

未来,视频链路将成为 AI 模型的主要输入通道,80% 以上的决策会由算法实时生成,人类更多扮演监督与干预角色。

-

这要求链路延迟必须低于 200ms,才能确保 AI 决策与环境变化“同频”。

趋势 2:边缘智能与视频链路深度融合

-

边缘计算节点将直接部署在无人机、机器人、工业控制器等设备附近,实现本地视频解析与初步决策。

-

视频链路不再只是“传输数据”,而是承载边缘端与云端的双向推送与同步,支持实时分工(本地快速响应 + 云端全局调度)。

趋势 3:多模态数据统一传输

-

未来的 AI 控制系统不仅依赖视频,还需要融合 LiDAR、红外、IMU、温度、声音等多源数据。

-

大牛直播SDK 的模块化协议栈将向多模态传输扩展,使视觉、感知、控制信号在同一链路中传输,降低系统集成复杂度。

大牛直播SDK的未来定位

作为跨平台、模块化、可嵌入的实时音视频基础框架,大牛直播SDK(SmartMediaKit)将在未来操控类系统中扮演三重角色:

-

视觉神经基建

-

提供稳定、低延迟、跨平台的视频通道

-

支撑 AI 模型的实时感知输入

-

-

闭环调度枢纽

-

通过双向传输支持 AI 决策即时下发

-

保障执行机构在动态环境下快速响应

-

-

多模态融合平台

-

扩展至视频 + 传感器 + 控制信号的统一传输

-

降低未来多传感融合系统的架构复杂性

-

结语

在 AI 驱动的操控系统中,视频链路不再是一个可选组件,而是整个系统的生命线。

未来,无论是空中低空经济、陆地智能机器人,还是工业远程控制,大牛直播SDK都将以其超低延迟、模块化和跨平台特性,继续作为这条“视觉神经高速公路”最稳固的基石,推动 AI 从“看得见”到“能执行”的协同进化。

📎 CSDN官方博客:音视频牛哥-CSDN博客