多模态融合 + 动态记忆机制,突破模态壁垒,超火研究方向

分享一个正在热门的研究方向:联邦/迁移学习×多模态融合。当数据孤岛、隐私壁垒与模态缺失成为常态,传统“全量微调+对齐”已无力招架;于是“一次通信即可泛化”“缺失模态也能精准推理”“风格即知识可筛选累积”的新范式迅速升温。当下顶会论文正围绕“单轮联邦蒸馏”“跨模态鲁棒迁移”“正风格记忆与连续利用”三大主题卷出新高度,想发论文,先锁定这三大切口。

本文精选3篇NeurIPS/ACM MM 2025迁移+多模态前沿工作,拆解思路、创新点。满满干货,点赞收藏不迷路~

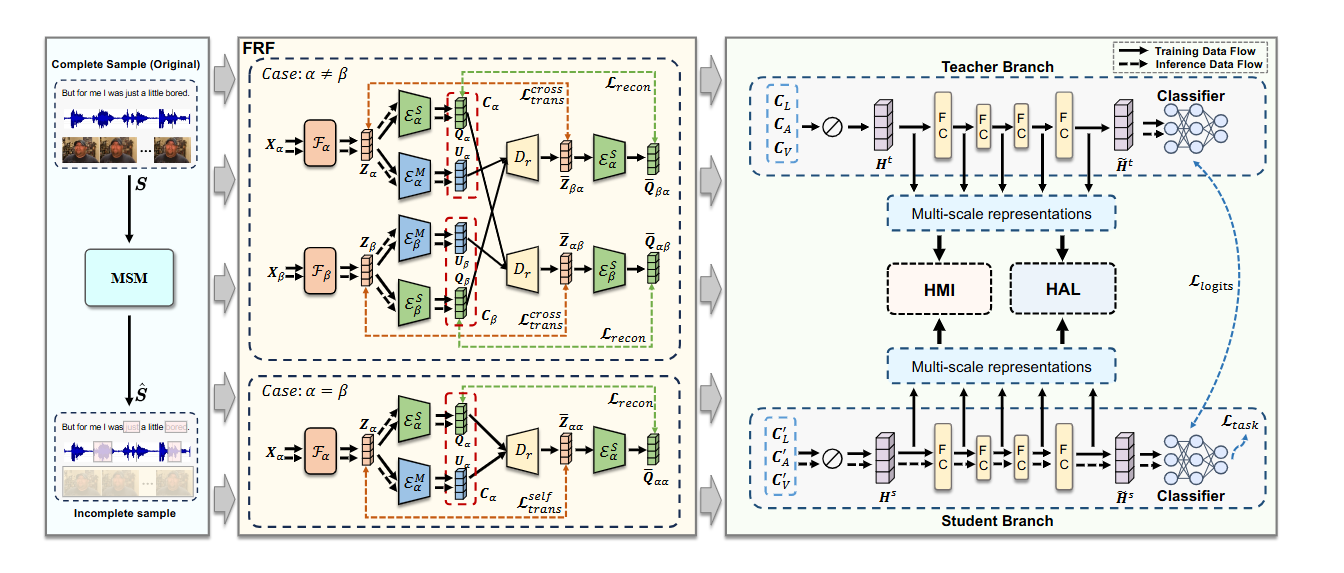

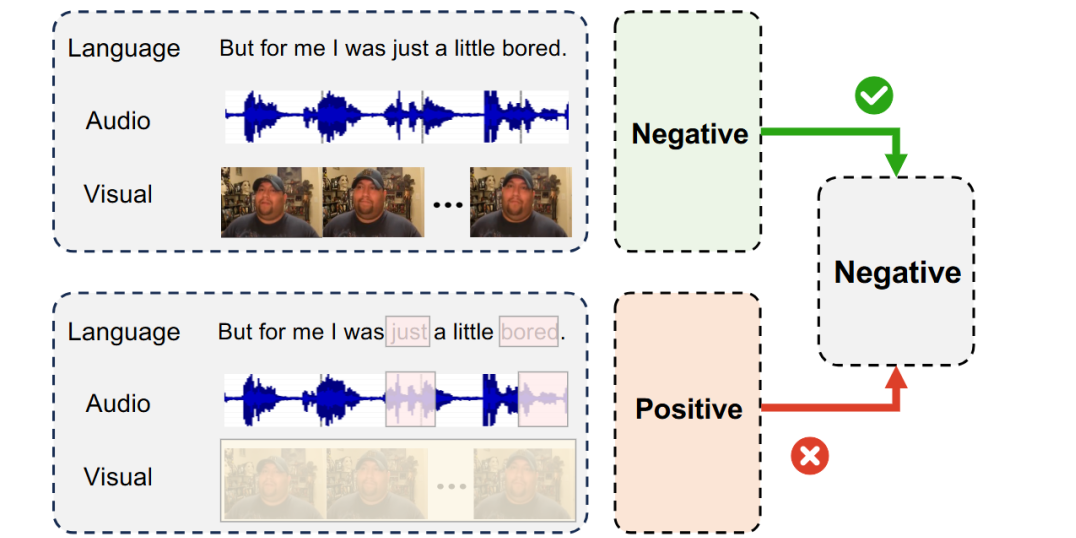

Toward Robust Incomplete Multimodal Sentiment Analysis via Hierarchical Representation Learning

方法:先用教师网在完整数据上预训练,再用随机掩蔽策略生成缺失样本送入学生网;两网同步通过FRF模块把各模态分解为情感相关与模态特定表示,随后利用HMI在多层特征间最大化互信息以蒸馏语义,并通过HAL让判别器在多尺度上对抗训练以进一步对齐分布;最终融合所有损失端到端优化,使学生在推理时仅凭残缺输入即可输出鲁棒的情感预测。

创新点:

首次将每种模态拆成“情感相关”与“模态私有”双空间,并通过跨模态翻译与情感语义重建实现细粒度提纯。

设计了层级互信息最大化机制,在教师-学生网络的多尺度表征间逐层对齐高层语义,实现残缺模态下的知识蒸馏。

引入层级对抗学习,按尺度渐进式约束学生网络的潜在分布逼近教师,从而生成稳定且一致的多模态联合表征。

总结:这篇文章直面现实场景中最棘手的“多模态情感分析在不确定模态缺失下崩溃”难题,提出一套让模型即便面对大片数据黑洞仍能精准读心的鲁棒框架。

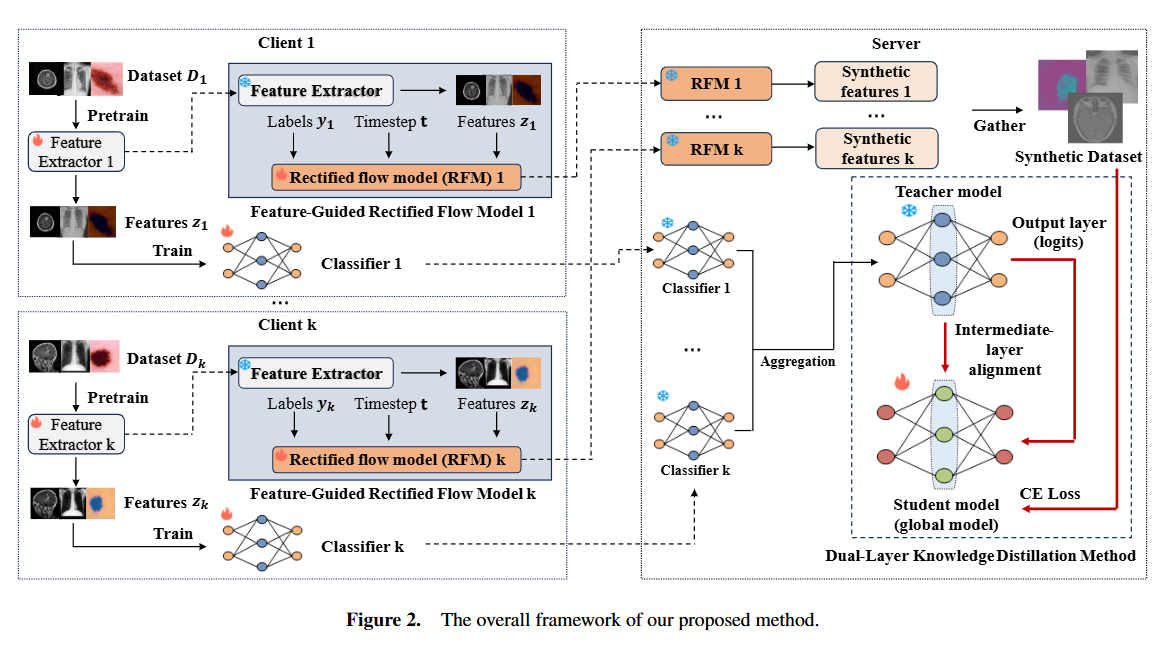

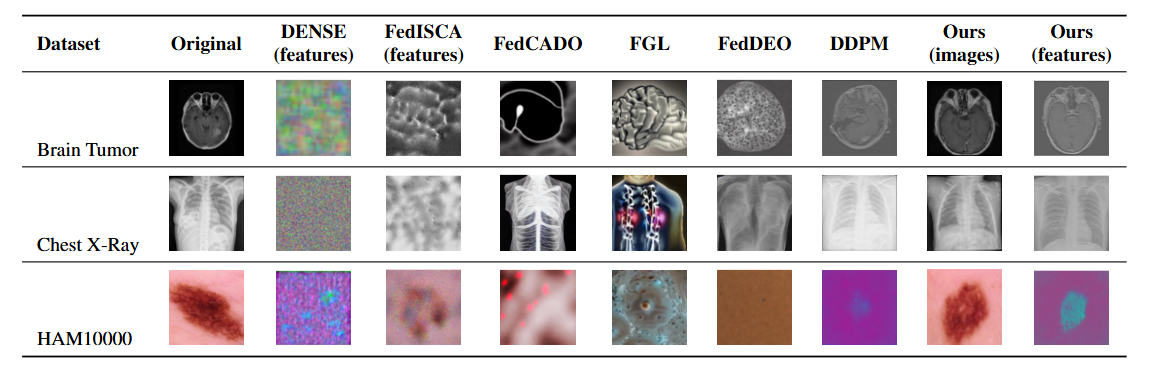

A New One-Shot Federated Learning Framework for Medical Imaging Classification with Feature-Guided Rectified Flow and Knowledge Distillation

方法:各客户端先用 ResNet-18 训练轻量级特征提取器获得不可逆特征,再用 DiT 构建的 Rectified Flow Model 学习该特征空间的 ODE 速度场并上传模型;服务器汇总所有客户端 RFM 生成全局特征级合成数据集,并以 DLKD 方式训练全局学生模型,使其在交叉熵、KL 蒸馏及中间层 L2 对齐的联合损失下一次性完成聚合。

创新点:

提出 Feature-Guided Rectified Flow Model(FG-RF),用特征级而非像素级合成的可逆流模型将训练与推理时间压缩数倍并大幅降低隐私泄露。

设计 Dual-Layer Knowledge Distillation(DLKD),在全局学生模型聚合时同时蒸馏客户端教师的输出 logits 与深层中间特征,显著缓解非 IID 带来的分布漂移。

首次为 FG-RF 与 DLKD 提供基于互信息瓶颈与域适应理论的隐私与泛化误差上界证明,给出可量化的安全与性能保证。

总结:这篇文章用一次通信就搞定多中心医疗影像联邦学习,既攻克非独立同分布数据难收敛又堵住像素级合成图像的隐私漏洞。

纠结选题?导师放养?投稿被拒?对论文有任何问题的同学,欢迎来gongzhonghao【图灵学术计算机论文辅导】,获取顶会顶刊前沿资讯~

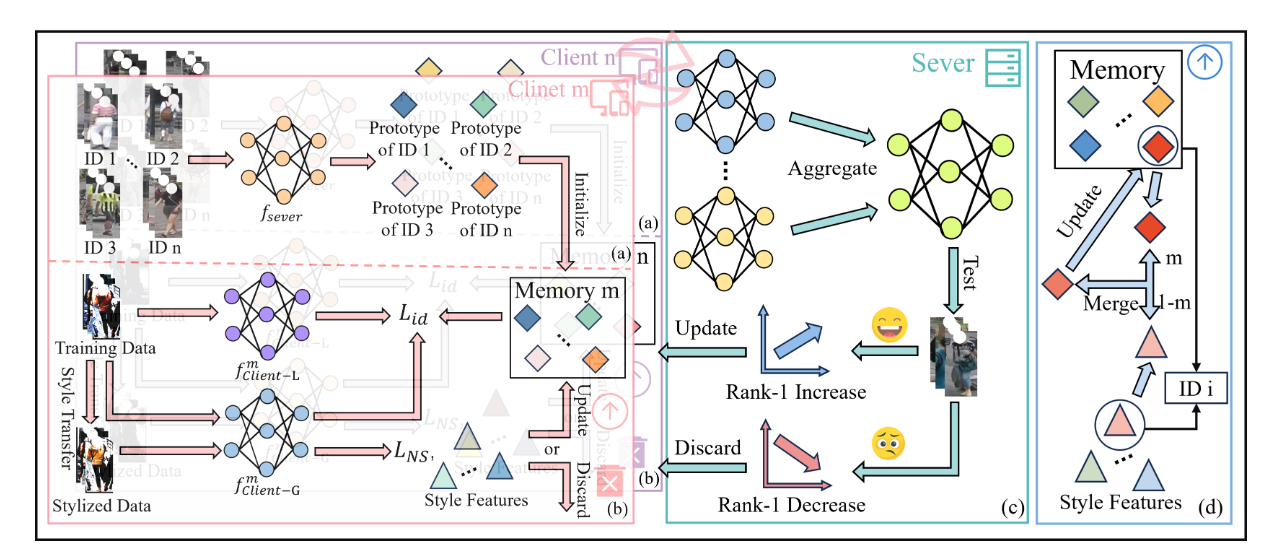

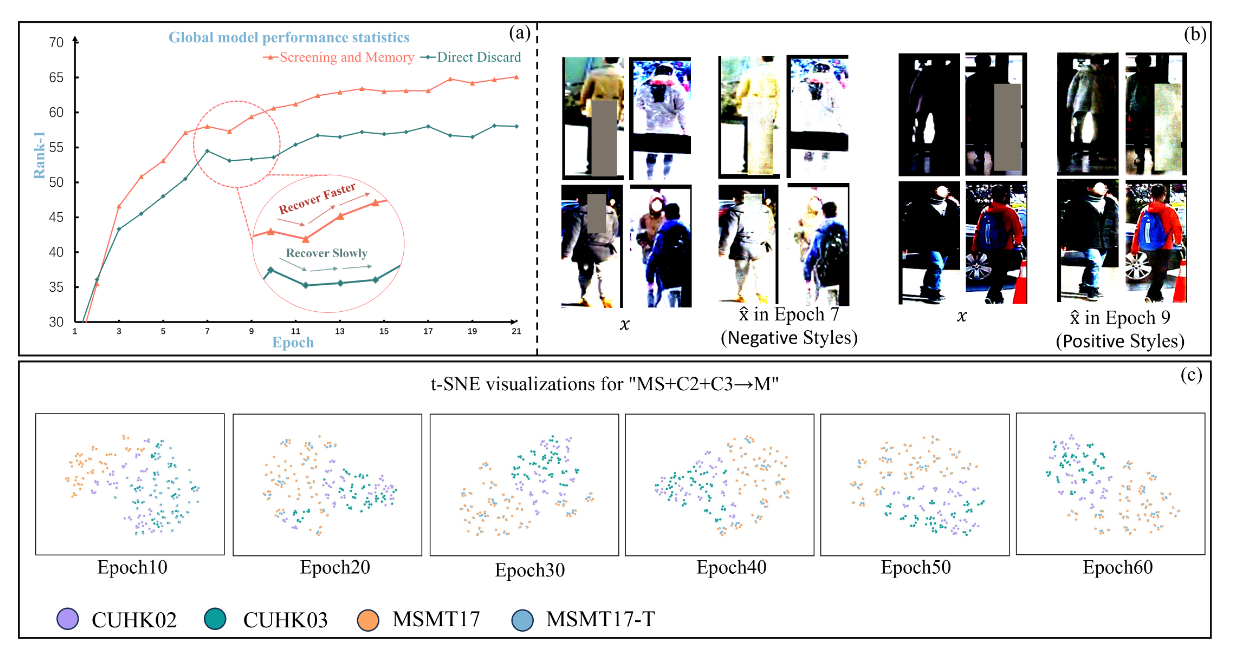

Positive Style Accumulation: A Style Screening and Continuous Utilization Framework for Federated DG-ReID

方法:每轮客户端先用全局模型提取各类原型并初始化记忆库,随后利用风格迁移网络生成风格化样本,若该风格使全局模型 Rank-1 提升则将其特征动量合并到对应原型;本地训练阶段,客户端并行执行两条分支——一条用新风格样本训练全局模型以迅速适应变化,另一条用原始样本并计算 Style Memory Recognition Loss 以不断巩固已验证的正风格。

创新点:

提出 Generalization Gain-guided Dynamic Style Memory以 Rank-1 增益为判据,在线筛选并动量更新正风格原型库,避免负风格干扰。

设计 Style Memory Recognition Loss,通过拉近特征与正风格原型距离、推远负类原型,显著提升模型对风格扰动的鲁棒性。

提出 Collaborative Style Training双分支策略:新风格适应分支快速吸收最新风格变化,正风格持续利用分支长期巩固记忆,实现新旧风格协同进化。

总结:这篇文章首次揭示“并非所有风格迁移都对跨域行人重识别有益”,在联邦场景下用动态记忆精准过滤并持续累积真正提升泛化的正风格,刷新 FedDG-ReID 上限。

关注gongzhonghao【图灵学术计算机论文辅导】,快速拿捏更多计算机SCI/CCF发文资讯~