同花顺前端潜在面试题目与答案

潜在面试题目与答案

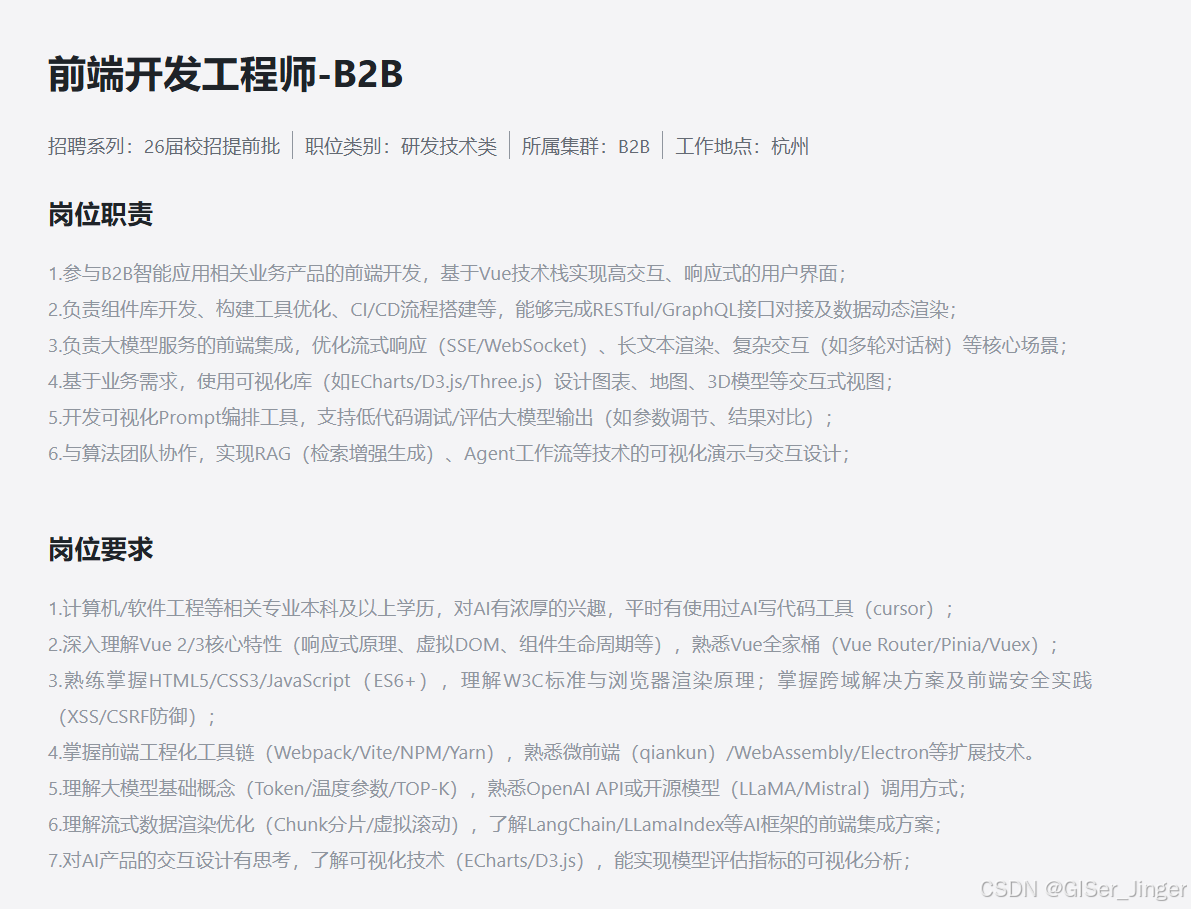

以下是根据您提供的“岗位职责”和“岗位要求”整理出的潜在面试题目和参考答案。请注意,这些答案仅供参考,您需要根据自己的实际经验和理解进行更详细和个性化的阐述。

一、基础技术知识(Vue/前端工程化/HTML/CSS/JS)

1. Vue 2/3 核心特性和Vue全家桶

- 问题: 您能详细阐述 Vue 2 和 Vue 3 在响应式原理、虚拟 DOM 和组件生命周期方面的区别吗?在实际项目中,您是如何选择 Vue 2 还是 Vue 3 的?请举例说明您在项目中如何使用 Vue Router、Pinia/Vuex 进行状态管理?

- 参考答案:

- 响应式原理: Vue 2 使用

Object.defineProperty进行数据劫持,对数组的变动需要特殊处理。Vue 3 则使用 Proxy 代理整个对象,能够更全面地监听数据变化,并解决了 Vue 2 中数组和对象新增/删除属性的响应式问题,性能也更好。 - 虚拟 DOM: Vue 3 引入了 静态提升(Static Hoisting) 和 补丁标志(Patch Flag),优化了虚拟 DOM 的生成和对比过程,使得渲染性能更高。

- 组件生命周期: Vue 3 的生命周期钩子名称有所调整(如

beforeDestroy改为beforeUnmount),并且提供了setup函数,使得组件逻辑组织更灵活,更利于组合式 API 的使用。 - 选择 Vue 2/3: 通常会优先选择 Vue 3,因为它性能更好、API 更易用且更符合未来前端发展趋势。但如果项目依赖大量 Vue 2 生态的库且迁移成本高,或者项目需要兼容低版本浏览器,可能会考虑继续使用 Vue 2。

- Vue Router/Pinia/Vuex: 阐述在项目中使用 Vue Router 进行路由管理,包括动态路由、嵌套路由、导航守卫等。对于状态管理,如果项目规模较小或更注重组合式 API 风格,会选择 Pinia,因为它更轻量、API 更简单直观;如果项目规模较大或需要更严格的状态管理,可能会选择 Vuex(Vue 2)或 Pinia(Vue 3)。举例说明如何使用它们管理用户登录状态、购物车数据等。

- 响应式原理: Vue 2 使用

2. 前端工程化工具链

- 问题: 请阐述 Webpack 和 Vite 在前端工程化中的作用及主要区别。在您过去的实践中,更倾向于使用哪一个,为什么?您对微前端架构(qiankun)有何理解,它在什么场景下适用?

- 参考答案:

- Webpack vs. Vite: Webpack 是基于打包器(Bundler)的,将所有模块打包成静态资源,构建过程相对复杂,但生态成熟。Vite 是基于 ESM(ECMAScript Modules)的,利用浏览器原生 ES Modules 支持实现按需编译,开发服务器启动速度和热更新速度极快,在开发阶段体验远超 Webpack。

- 选择: 如果是新项目,会优先选择 Vite,因为它在开发体验和构建性能上都有显著优势。如果是需要处理大量兼容性问题或有复杂自定义构建需求的老项目,Webpack 依然是可靠的选择。

- 微前端(qiankun): 微前端是一种将大型前端应用拆分成多个独立的小应用的技术,每个小应用可以独立开发、部署和运行。qiankun 是一个基于

single-spa的微前端框架,它提供了一套完整的微前端解决方案,包括应用注册、沙箱隔离、样式隔离、路由管理等。适用场景包括:大型单页应用需要团队协作并行开发、旧系统平滑升级、不同技术栈共存等。

3. HTML5/CSS3/JavaScript (ES6+)

- 问题: 请解释浏览器的渲染原理,从 HTML 解析到最终页面呈现的整个过程。您是如何处理前端跨域问题的?请列举几种常见的跨域解决方案并解释其原理。

- 参考答案:

- 浏览器渲染原理:

- 解析 HTML: 浏览器将 HTML 文件解析成 DOM 树(Document Object Model)。

- 解析 CSS: 浏览器解析 CSS 文件,生成 CSSOM 树(CSS Object Model)。

- 构建渲染树: 将 DOM 树和 CSSOM 树合并,生成 渲染树(Render Tree)。渲染树只包含需要渲染的可见元素及其样式。

- 布局(Layout/Reflow): 计算渲染树中每个元素在屏幕上的确切位置和大小。

- 绘制(Painting): 将渲染树中的元素转换为像素,并绘制到屏幕上。

- 合成(Compositing): 将不同层绘制的图像进行合成,最终显示在屏幕上。

- 跨域解决方案:

- CORS (Cross-Origin Resource Sharing): 服务器设置响应头

Access-Control-Allow-Origin允许特定域名的请求。 - JSONP (JSON with Padding): 利用

<script>标签没有跨域限制的特点,通过动态创建<script>标签向服务器发送请求,服务器返回一个函数调用,并将数据作为参数传入。 - 代理(Proxy): 在同源服务器上设置一个代理,前端请求代理服务器,代理服务器再去请求目标服务器。

- WebSocket: WebSocket 协议本身没有同源策略限制,可以进行跨域通信。

- Nginx 反向代理: 通过 Nginx 配置,将不同域名的请求代理到同一个源下。

- CORS (Cross-Origin Resource Sharing): 服务器设置响应头

- 浏览器渲染原理:

二、AI/大模型相关技术

4. 大模型服务前端集成与优化

- 问题: 您在集成大模型服务时,如何优化流式响应(SSE/WebSocket)、长文本渲染和复杂交互(如多轮对话树)等核心场景?您对 LangChain/LLamaIndex 等 AI 框架的前端集成方案有何了解?

- 参考答案:

- 流式响应优化(SSE/WebSocket):

- SSE (Server-Sent Events): 适合单向数据流,服务器向客户端推送数据。在前端,可以使用

EventSourceAPI 监听事件。优化方面,可以考虑分块传输、错误重连机制等。 - WebSocket: 适合双向实时通信。在前端,可以使用

WebSocketAPI。优化方面,可以考虑心跳机制、消息队列、断线重连等。 - 应用: 对于大模型生成长文本时,使用流式响应可以大大提升用户体验,避免长时间等待。

- SSE (Server-Sent Events): 适合单向数据流,服务器向客户端推送数据。在前端,可以使用

- 长文本渲染优化:

- Chunk 分片: 将长文本按一定策略(如句子、段落)分割成小块,逐步渲染,减少单次渲染的压力。

- 虚拟滚动(Virtual Scrolling): 对于非常长的文本列表,只渲染可视区域内的内容,非可视区域的内容进行懒加载或动态加载,避免 DOM 元素过多造成的性能问题。

- 复杂交互(多轮对话树)优化:

- 状态管理: 使用 Vuex/Pinia 精心设计对话状态,包括当前对话轮次、用户输入历史、AI 输出历史等。

- 组件设计: 将对话界面拆分成独立的组件,如消息组件、输入框组件、操作按钮组件等,提高复用性和可维护性。

- 数据结构: 对于多轮对话树,可以使用树形结构或数组嵌套来存储对话历史,便于遍历和渲染。

- LangChain/LLamaIndex 前端集成: 这些是用于构建 LLM 应用程序的框架。前端集成通常涉及调用其暴露的 API,例如:

- LangChain.js: 可以在前端直接使用 LangChain.js 库,通过其提供的 Chain、Agent 等概念构建复杂的 LLM 应用,并与前端 UI 进行交互。

- 后端 API 封装: 更常见的是,LangChain/LLamaIndex 在后端构建 LLM 应用,然后前端通过调用后端暴露的 RESTful API 或 GraphQL API 来与 LLM 进行交互。

- 流式响应优化(SSE/WebSocket):

5. 可视化技术与 AI 产品交互设计

- 问题: 您对 AI 产品的交互设计有何思考?在实际项目中,您如何利用 ECharts/D3.js 等可视化库实现模型评估指标的可视化分析?请举例说明。

- 参考答案:

- AI 产品交互设计思考:

- 清晰的反馈: AI 模型通常有不确定性,需要清晰地告知用户当前模型的状态、处理进度、潜在限制等。

- 可解释性: 尽可能可视化模型决策过程,帮助用户理解 AI 的判断依据。

- 可控性: 提供灵活的参数调节、结果对比等功能,让用户能够干预和优化 AI 输出。

- 简洁直观: 避免过多的专业术语,使用图形、图表等直观方式展示复杂信息。

- 错误处理: 明确的错误提示和引导,帮助用户解决问题。

- 模型评估指标可视化:

- ECharts: 可以利用 ECharts 绘制折线图、柱状图、散点图等来展示模型的准确率、召回率、F1 值、损失函数变化曲线等。例如,通过折线图展示模型训练过程中准确率的提升趋势,通过柱状图对比不同模型的评估指标。

- D3.js: D3.js 提供了更底层的控制,可以创建高度定制化的可视化。例如,绘制混淆矩阵(Confusion Matrix)的热力图,直观展示分类模型的性能;或者绘制 ROC 曲线,评估二分类模型的性能。

- 举例: 在一个图像识别项目中,我使用 ECharts 绘制了一个折线图,展示了不同训练轮次下模型的准确率和损失函数的变化,帮助我们及时调整训练策略。同时,也使用 ECharts 绘制了混淆矩阵,通过颜色的深浅直观地展示了模型在不同类别上的识别准确度。

- AI 产品交互设计思考:

三、综合与项目经验

6. 大模型基础概念与调用方式

- 问题: 请解释大模型中的 Token、温度参数(Temperature)和 TOP-K 参数的含义及其对模型输出的影响。您有使用 OpenAI API 或开源模型(LLaMA/Mistral)的经验吗?请描述您的使用过程。

- 参考答案:

- Token: 在大模型中,Token 是最小的文本单位,可以是单词、子词或字符。模型的输入和输出都是以 Token 为单位进行处理的。Token 的数量会影响模型的计算量和成本。

- 温度参数(Temperature): 控制模型输出的随机性或创造性。

- 值越低(接近 0),模型输出越确定和保守,重复性高。

- 值越高(接近 1),模型输出越随机和富有创造力,多样性高。

- TOP-K 参数: 限制模型在生成下一个 Token 时只从概率最高的 K 个 Token 中选择。

- 值越小,模型越保守,倾向于选择最常见的词语。

- 值越大,模型选择范围更广,可能生成更不寻常的词语。

- 使用经验: 阐述您使用 OpenAI API(如 GPT-3.5/GPT-4)或开源模型(如 LLaMA/Mistral)的经验。可以包括:

- 如何获取 API Key。

- 如何构建 API 请求,包括设置模型、输入 Prompt、调整参数(如 temperature、max_tokens)。

- 如何处理 API 返回结果,包括解析 JSON、提取文本。

- 您在项目中如何应用这些模型,例如用于内容生成、代码辅助、文本摘要等。

7. RAG(检索增强生成)与 Agent 工作流可视化

- 问题: 您对 RAG(检索增强生成)和 Agent 工作流有何理解?在前端,您如何实现这些技术的可视化演示与交互设计,以提升用户体验?

- 参考答案:

- RAG(检索增强生成): 结合了信息检索和文本生成的技术。当用户提问时,RAG 系统会首先从一个大型知识库中检索相关信息,然后将这些信息与原始问题一起输入给大模型,让大模型基于检索到的信息生成更准确、更丰富的回答。

- Agent 工作流: 指的是大模型作为“智能代理人”,能够根据任务目标,自主规划、执行一系列工具调用和思考步骤,直到完成复杂任务。它模拟了人类解决问题的过程。

- 前端可视化与交互设计:

- RAG 可视化:

- 检索过程展示: 可以可视化检索到的文档片段或知识图谱节点,让用户了解模型回答的依据。例如,展示检索关键词、匹配度高的段落等。

- 信息溯源: 提供点击查看原始文档的链接或弹窗,方便用户核实信息来源。

- 用户反馈: 提供机制让用户对检索结果和生成内容进行反馈,帮助模型优化。

- Agent 工作流可视化:

- 步骤分解: 可视化 Agent 的思考过程,将其执行的每个步骤(如工具调用、中间思考结果)以流程图、列表或时间轴的形式展示出来。

- 工具调用状态: 实时显示 Agent 正在使用的工具及其调用结果,让用户了解任务进展。

- 交互式干预: 在某些关键节点,允许用户介入并修改 Agent 的决策或提供额外信息。

- 成功/失败提示: 清晰地提示 Agent 任务的成功或失败,并给出失败原因。

- 实现方式: 可以使用流程图库(如

GoJS、JointJS)、时间轴组件、树形图组件等来呈现这些复杂的工作流。

- RAG 可视化:

基于岗位职责和要求,以下是针对性的潜在面试题目及参考答案,涵盖技术深度、业务场景和解决方案设计:

一、Vue核心与高级特性

-

请对比Vue 2与Vue 3的响应式原理,并说明Vue 3的改进如何提升性能?

- 答案:

- Vue 2使用

Object.defineProperty劫持数据,需递归遍历对象且无法监听新增属性。 - Vue 3改用

Proxy代理,支持动态属性添加、数组索引修改,并减少初始化递归开销,提升性能。 - 性能提升点:响应式初始化速度提升40%,内存占用减少。

- Vue 2使用

- 答案:

-

如何优化Vue中长列表渲染性能?结合虚拟滚动与SSE流式渲染说明

- 答案:

- 虚拟滚动:仅渲染可视区域DOM(如

vue-virtual-scroller),减少节点数量。 - SSE流式渲染:分块接收数据并逐块渲染(

EventSource+v-for动态追加),避免一次性渲染阻塞UI。 - 关键代码:

const eventSource = new EventSource('/stream'); eventSource.onmessage = (event) => { chunks.value.push(JSON.parse(event.data)); // 分块追加数据 };

- 虚拟滚动:仅渲染可视区域DOM(如

- 答案:

二、大模型集成与优化

-

如何实现大模型流式响应(SSE/WebSocket)并优化用户体验?

- 答案:

- SSE适用场景:单向数据流(如实时日志),通过

Content-Type: text/event-stream分块传输。 - WebSocket适用场景:双向交互(如聊天),需处理重连、心跳机制。

- 优化点:

- 前端采用

<mark>Chunk分片渲染</mark>,避免长文本卡顿; - 添加

光标动画提示加载中状态。

- 前端采用

- SSE适用场景:单向数据流(如实时日志),通过

- 答案:

-

如何设计可视化Prompt编排工具?需支持参数调试与结果对比

- 答案:

- 架构设计:

- 左侧:拖拽式参数面板(温度、TOP-K等),使用

JSON Schema动态生成表单; - 右侧:双栏结果对比(历史记录+实时输出),支持高亮差异文本。

- 左侧:拖拽式参数面板(温度、TOP-K等),使用

- 技术实现:

- 基于

Vue Draggable实现拖拽; - 调用

OpenAI API时传递动态参数,并缓存结果至IndexedDB。

- 基于

- 架构设计:

- 答案:

三、可视化与复杂交互

-

如何用ECharts实现大模型评估指标(如准确率、延迟)的可视化?

- 答案:

- 图表选型:

- 折线图:展示训练迭代指标变化;

- 雷达图:多维度对比模型性能(响应速度、成本等)。

- 动态更新:通过

ECharts实例.setOption()实时更新数据,结合WebSocket推送。

- 图表选型:

- 答案:

-

多轮对话树的UI设计有哪些难点?如何解决?

- 答案:

- 难点:节点嵌套层级深、状态管理复杂(折叠/展开/高亮)。

- 解决方案:

- 使用

递归组件渲染树形结构; - 状态管理:Pinia存储当前激活节点,通过

节点ID定位路径。

- 使用

- 答案:

四、前端工程化与架构

-

如何优化CI/CD流程以支持AI应用的前端快速迭代?

- 答案:

- 流水线设计:

- 代码检查:

ESLint+单元测试(Jest); - 构建优化:Vite按需编译 + Docker镜像缓存;

- 灰度发布:Kubernetes滚动更新 + 流量染色。

- 代码检查:

- 流水线设计:

- 答案:

-

如何防御前端集成大模型时的XSS攻击?

- 答案:

- 输入过滤:对用户输入的Prompt参数转义(如

DOMPurify); - 输出处理:大模型返回内容需经

JSON序列化后再渲染,禁用v-html。

- 输入过滤:对用户输入的Prompt参数转义(如

- 答案:

五、AI产品思维与解决方案

-

设计RAG系统的前端演示界面时,如何平衡信息密度与用户体验?

- 答案:

- 分层展示:

- 第一层:简洁问答结果(默认折叠知识库来源);

- 第二层:展开显示检索来源(高亮匹配文本)+ 置信度评分。

- 交互优化:鼠标悬停显示知识片段预览,减少页面跳转。

- 分层展示:

- 答案:

-

如何实现LangChain的低代码集成?举例说明

- 答案:

- 封装SDK:将

LangChain调用封装为npm包,暴露useLangChain()钩子函数; - 可视化编排:拖拽组合链(Chain)节点,生成配置JSON并动态加载。

- 封装SDK:将

- 答案:

优化建议与考察点

- 性能优化重点:虚拟滚动(长列表)、流式分片(SSE)、缓存策略(Pinia持久化)。

- 安全必考:XSS防御(模型返回内容过滤)、Token加密传输。

- 架构设计能力:组件解耦(Composition API)、微前端隔离(qiankun)。

提示:面试中可结合具体项目举例(如:“我曾用虚拟滚动优化10万条日志渲染,FPS从5提升到60”),突出技术深度与业务落地能力。