大模型开发

什么是Ai?

AI的全拼是(Artificial Intelligence)人工智能,使机器能够像人类一样思考、学习和解决问题的技术。

在AI的应用情况下我们更多的是学习自然语言处理。

在自然语言处理(Natural Language Processing,NLP)中,有一项关键技术叫Transformer,这是一种先进的神经网络模型,是现如今AI高速发展的最主要原因。

我们所熟知的大模型(Large Language Models,LLM),例如GPT、Deepseek底层都是采用Transformer神经网络模型。

Transformer:最早由Google 团队发表 《Attention Is All You Need》提出了这一模型架构,采用 自注意力机制(Self-Attention)简单来说就是计算输入序列中每个词与其他词的关联权重进行输出,实现并行计算。

大模型的底层原理就是通过上下文的计算,生成下一个可能出现token,通过Transformer的神经网络,通过大量的数据训练,掌握自然语言规律。

大模型应用

大模型应用是基于大模型的推理,分析,生成能力,结合传统编程能力,开发出各种应用。

传统编程和AI大模型之间是有不同的侧重点的。

传统程序对于确定性逻辑处理和精确控制和高可靠性,比方说数学计算和内存管理,是擅长的。

AI大模型是对模糊性问题有很强的处理能力,比方说识别图片。

当我们把AI大模型和传统程序相联合在一起的时候,我们就得到了大模型应用。比方说AI大模型是没有记忆能力的,它实际上是在用户传递过来之后,在后台进行了传统编程使它缓存下来,然后再和你新的问题一起发送回大模型,这样就达到了AI大模型的记忆功能了。

注意!!!

大模型和大模型应用是不一样的,比方说deepseek是大模型应用,是基于大模型进行开发的,像deepseek-R1就是大模型像这样的还有很多,基于大模型应用的就是大模型产品也就是我们在网站上使用的对话产品,比如ChatGPT,文心一言。

AI应用开发技术架构

AI应用开发技术是围绕大语言模型构建应用程序所涉及的一系列技术和方法。

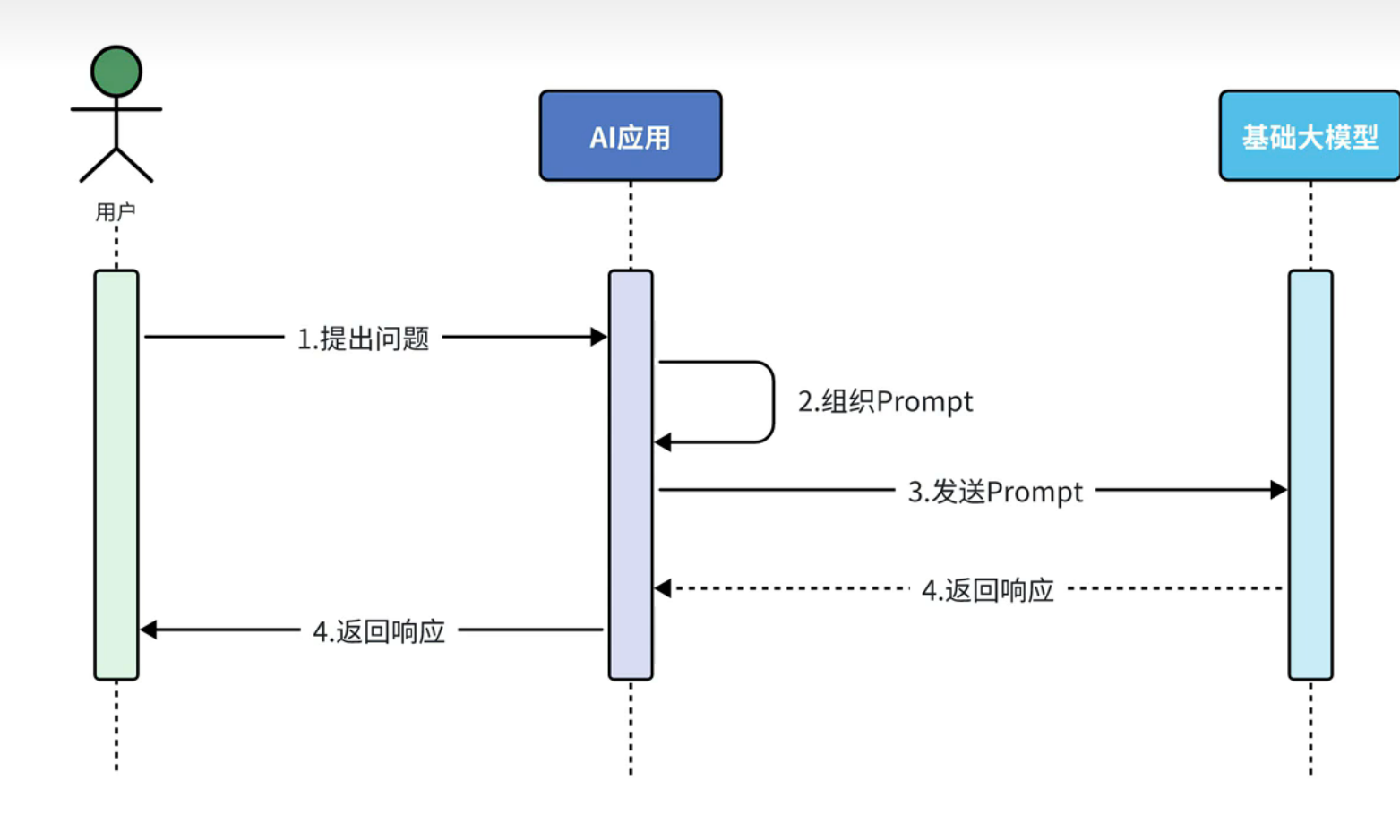

纯 Prompt 问答(Pure Prompt Q&A):利用大模型推理能力,通过 Prompt 指令完成业务

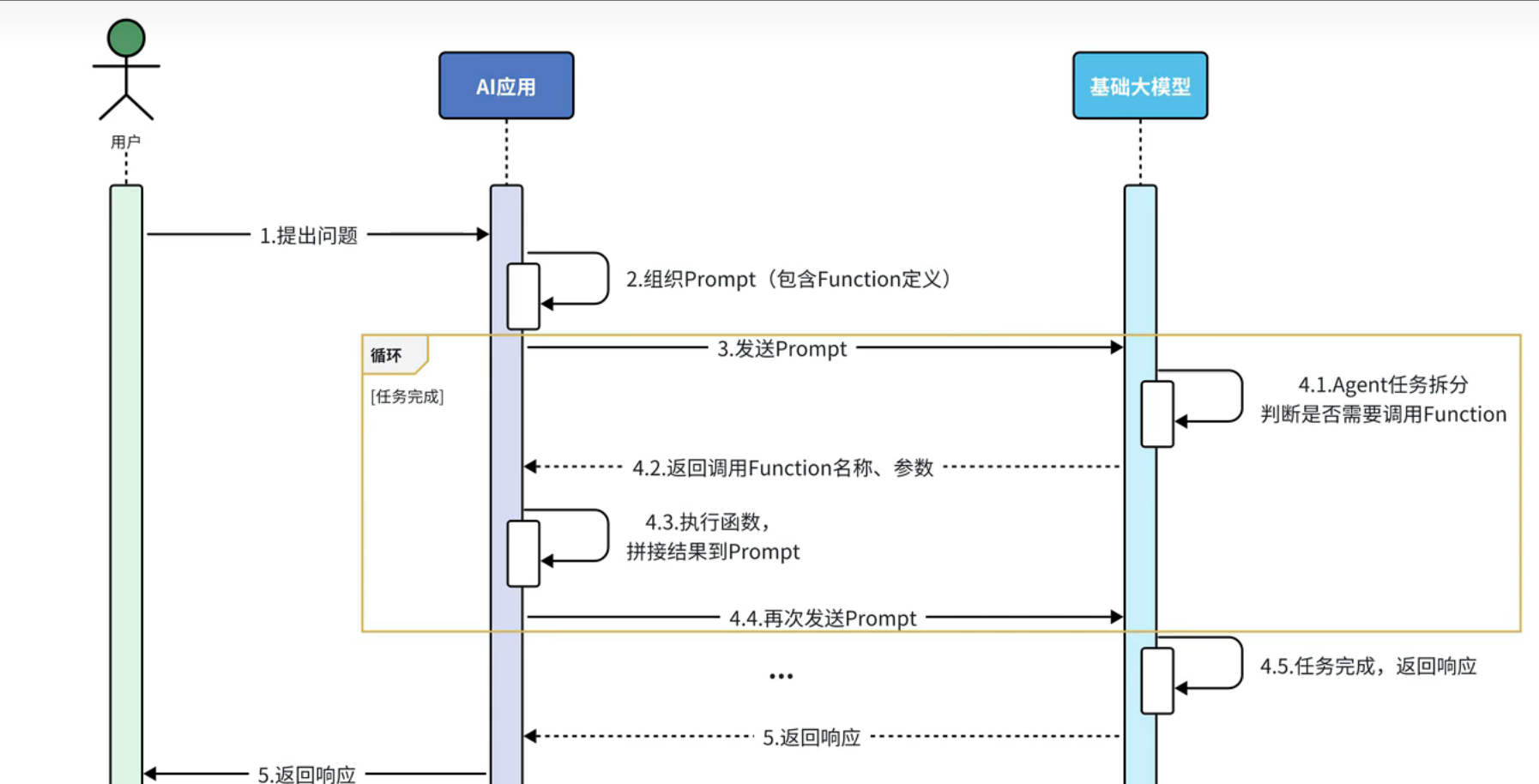

Agent + Function Calling:AI 拆解任务,调用业务端接口实现复杂业务

Fine - tuning(微调):针对特有业务场景,对基础大模型做数据训练、微调,满足特定场景需求

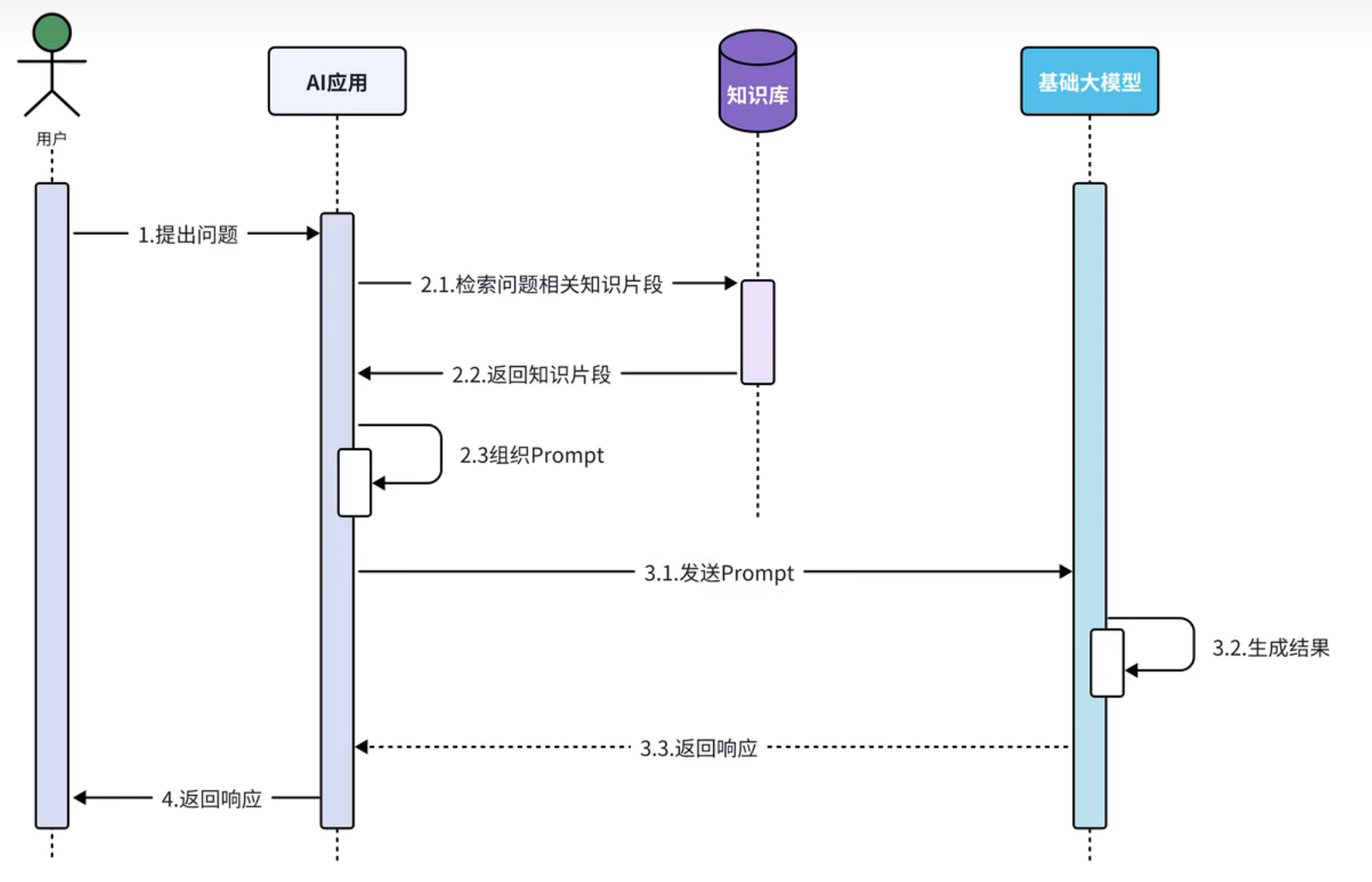

RAG(Retrieval Augmented Generation,检索增强生成):给大模型外挂知识库,基于知识库内容推理、回答 ,这些模式用于不同业务场景下借助大模型能力开展工作 。

应用场景:

纯 Prompt 问答:通过简洁指令让大模型直接响应,适用于智能客服快速答疑、简单文本创作辅助等轻量场景 。

Fine-tuning(微调):针对医疗、金融等垂直领域,用专业数据优化模型,满足医疗诊断辅助、金融风险评估等深度需求 。

Agent + Function Calling:借助智能体拆解复杂任务并调用外部接口,在自动化办公流程(如跨系统报表生成)、智能家居联动控制等场景,高效完成多步骤业务 。

RAG(检索增强生成):外挂知识库补充实时 / 专业信息,常用于企业内部知识问答(精准调用企业文档)、新闻写作(结合最新资讯)等对内容准确性、时效性要求高的场景 。