融合Transformer与CNN,实现各任务性能巅峰,可训练参数减少80%

论文er看过来,今天给各位推荐一个热门创新方向:CNN+Transformer。

众所周知,CNN通过多层卷积自动学习空间层级特征,能够有效提取图像局部特征。而Transformer通过自注意力机制全局建模,能够有效处理长距离依赖关系。

通过结合这两者的优势,我们不仅可以在保持运算效率的同时,提高模型在多种计算机视觉任务中的性能,还能实现较好的延迟和精度之间的权衡。

举个栗子:混合架构Lite-Mono。

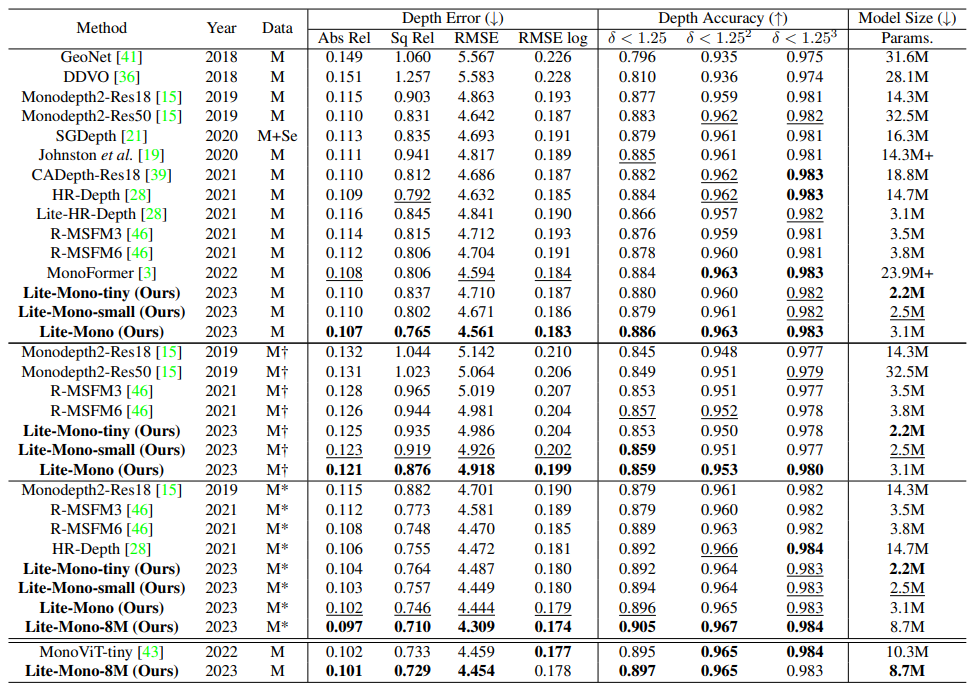

该模型主要包含两个模块,CDC模块用于提取增强的多尺度局部特征,LGFI模块用于编码长距离的全局特征。实验表明,Lite-Mono在精度上优于Monodepth2,可训练参数减少了80%左右。

目前,这种策略通过多种方式融合两种模型的优点。主流的方法包括早期层融合、横向层融合、顺序融合、并行融合等。我这次整理了17种最新的CNN+Transformer结合方案,原文以及开源代码都附上了,方便各位学习。

论文原文以及开源代码需要的同学看文末

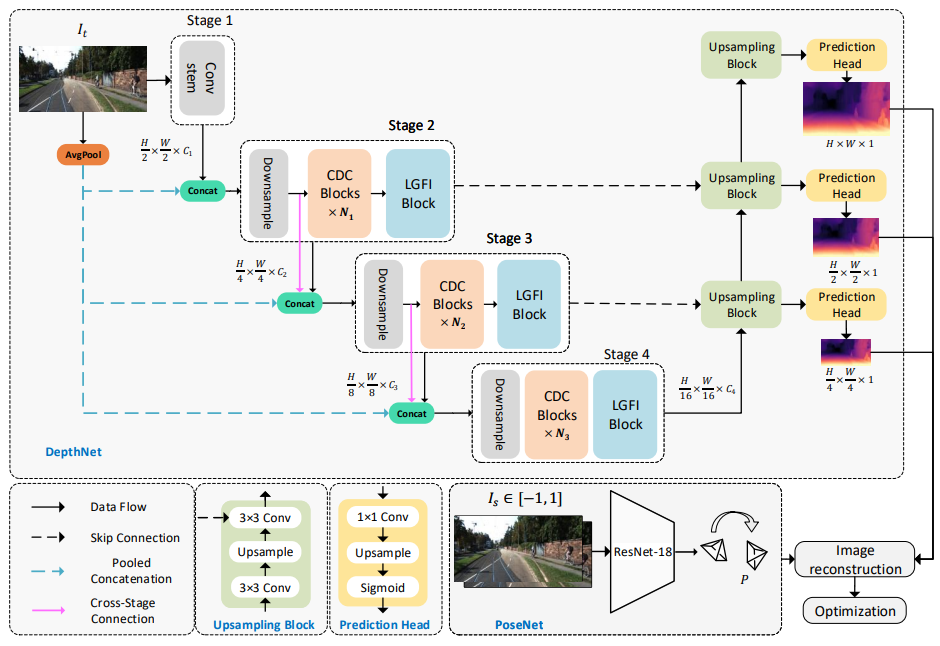

Lite-Mono: A Lightweight CNN and Transformer Architecture for Self-Supervised Monocular Depth Estimation

方法:本文提出了一种轻量级的自监督单目深度估计模型Lite-Mono,该模型采用了高效的CNN和Transformer的组合。模型设计了连续空洞卷积(CDC)模块和局部-全局特征交互(LGFI)模块,前者用于提取丰富的多尺度局部特征,后者利用自注意机制将长距离的全局信息编码到特征中。

创新点:

-

提出了一种轻量级高效的自监督单目深度估计模型,采用了混合的卷积神经网络(CNN)和Transformer架构。

-

在所提出的编码器的每个阶段中,采用了连续膨胀卷积(CDC)模块来捕捉增强的多尺度局部特征,并且使用了局部-全局特征交互(LGFI)模块来计算MHSA并将全局上下文编码到特征中。

-

为了减少计算复杂性,本文在通道维度而非空间维度上计算交叉协方差注意力。

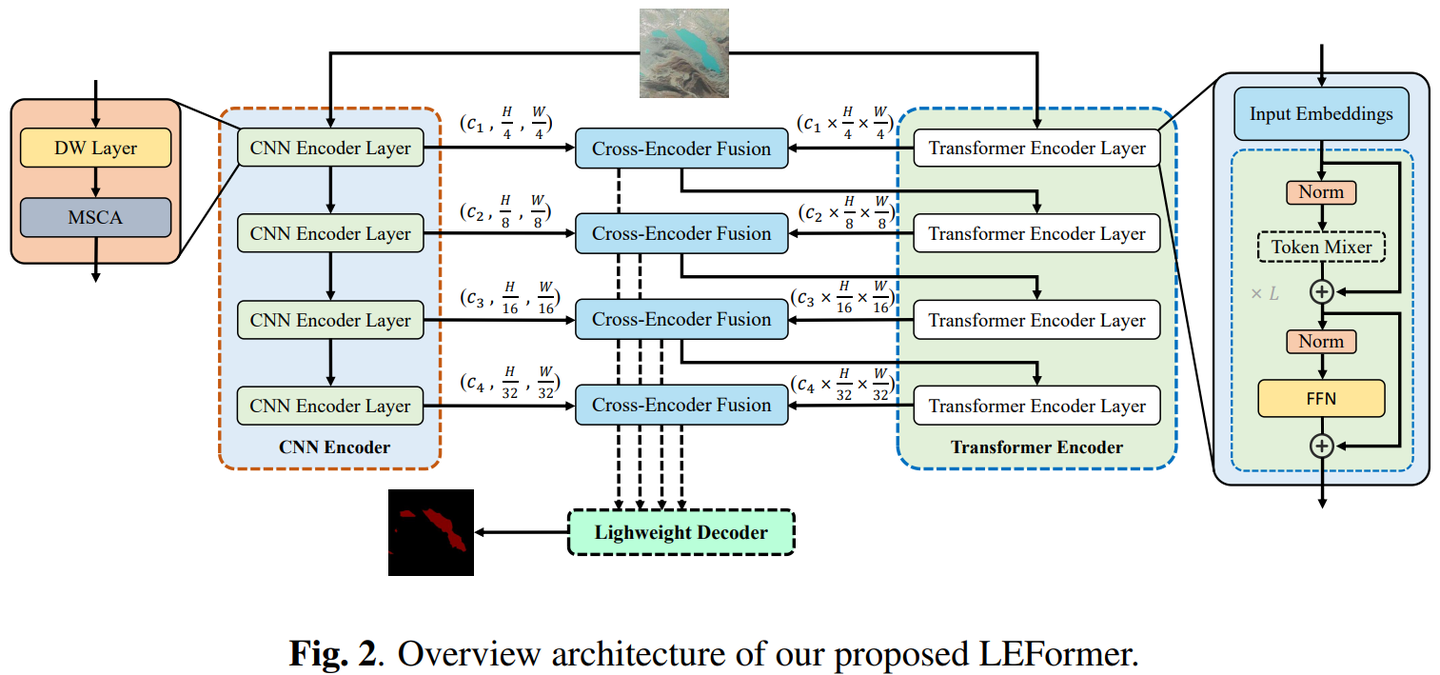

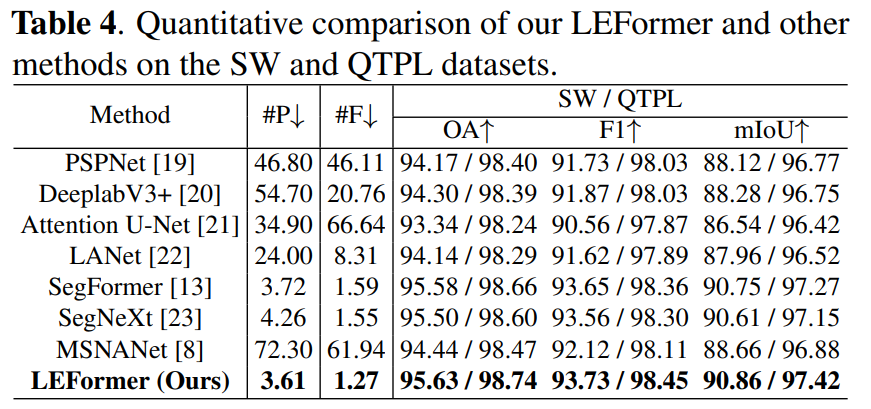

LEFORMER: A HYBRID CNN-TRANSFORMER ARCHITECTURE FOR ACCURATE LAKE EXTRACTION FROM REMOTE SENSING IMAGERY

方法:论文提出了一种名为LEFormer的混合CNN-Transformer架构,用于从遥感图像中准确地提取湖泊。LEFormer包含三个主要模块:CNN编码器、Transformer编码器和交叉编码器融合。

CNN编码器有效地恢复了局部空间信息,并改善了细节。同时,Transformer编码器捕捉了任意长度序列之间的长距离依赖关系,使其能够获得全局特征和上下文信息。交叉编码器融合模块将CNN和Transformer提取的局部和全局特征融合为统一的特征,用作生成的湖泊掩码的输入。

创新点:

-

提出了LEFormer,一种用于高性能湖泊提取的新型架构。LEFormer结合了CNN和Transformer,以捕捉湖泊遮罩预测所需的短程和长程依赖关系,从而获得强大的特征。LEFormer在两个基准数据集上实现了SOTA性能和效率。

-

提出了轻量级Transformer编码器,降低了模型的计算和参数需求,同时保持高性能。通过CNN和Transformer提取的局部和全局特征经过交叉编码器融合模块融合,作为生成湖泊遮罩的统一特征输入。这种结构实现了高准确性和低计算成本的轻量级网络结构。

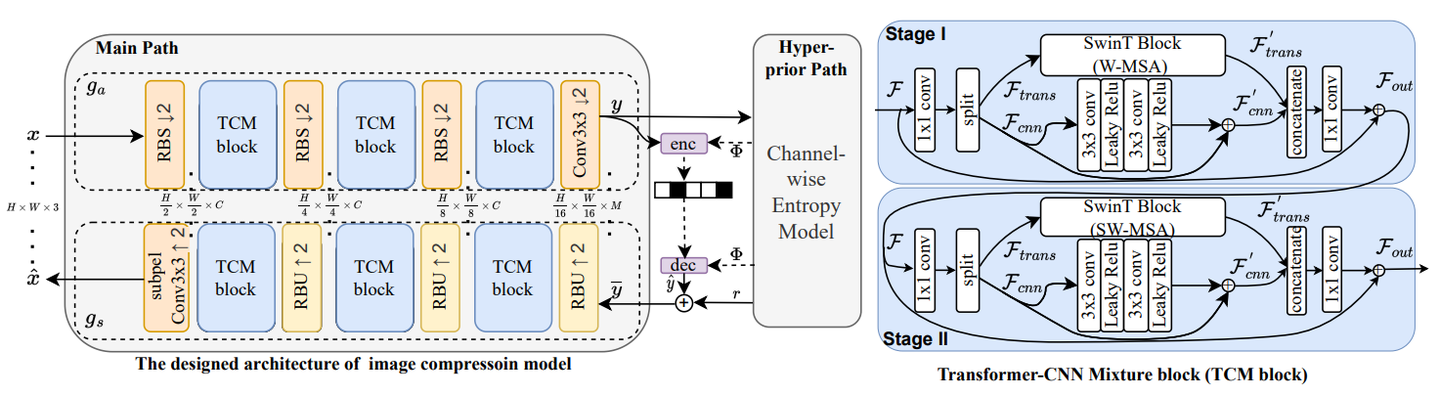

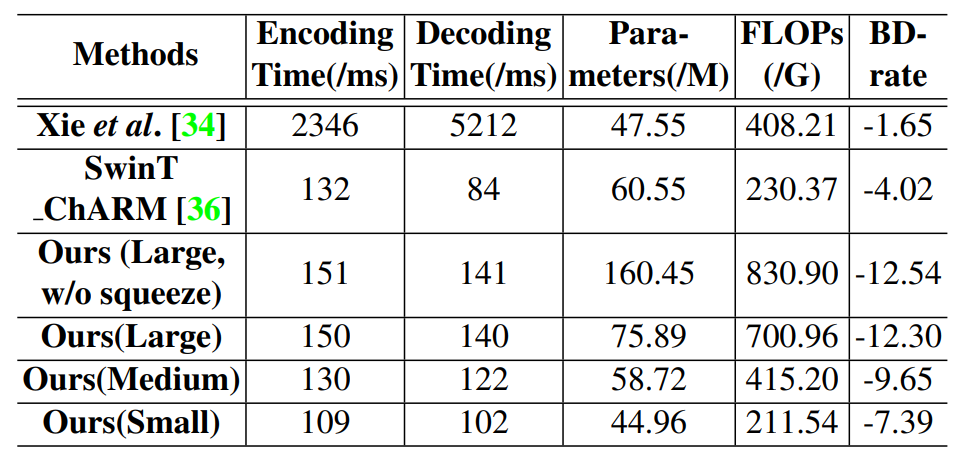

Learned Image Compression with Mixed Transformer-CNN Architectures

方法:论文提出了一种高效的并行Transformer-CNN混合(TCM)块,将CNN的局部建模能力和Transformer的非局部建模能力相结合,进而设计了一种新的基于TCM块的图像压缩架构,并提出了一种基于Swin-Transformer的注意力模块来改进通道熵模型的性能。

创新点:

-

提出了一个高效的并行Transformer-CNN混合(TCM)块,以将CNN的局部建模能力和Transformer的非局部建模能力有效结合,从而改进了图像压缩模型的整体架构。

-

基于最新的熵估计模型和注意力模块的进展,提出了一种使用通道压缩的参数高效的Swin-Transformer-based attention(SWAtten)模块的通道自回归熵模型。

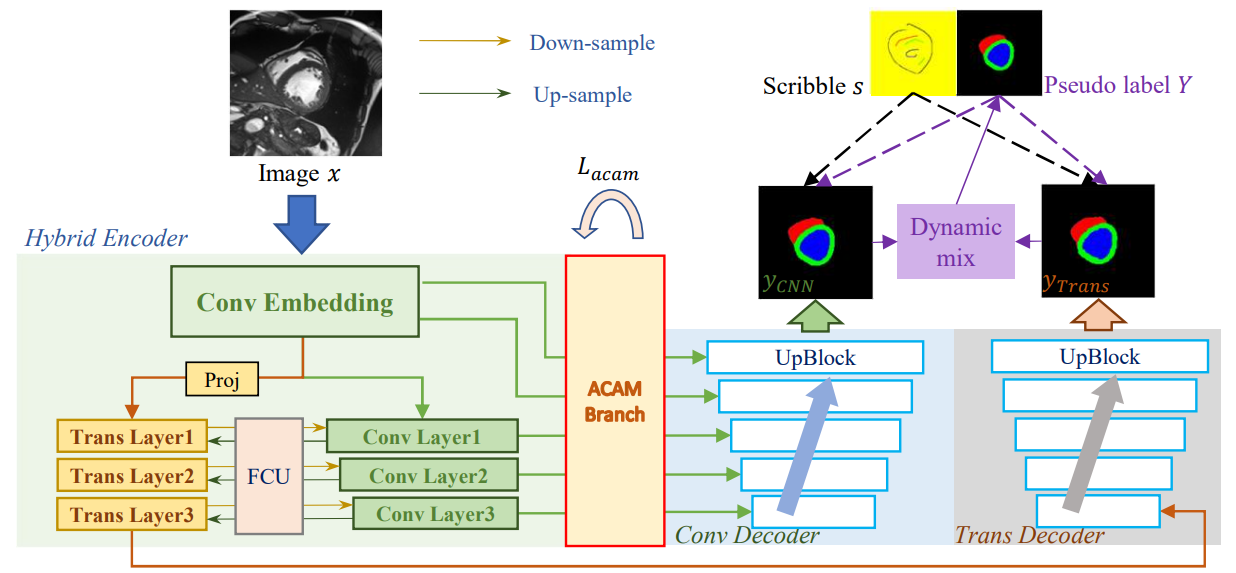

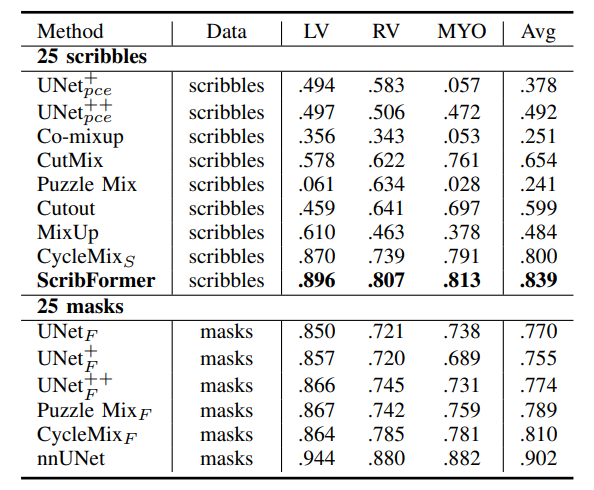

ScribFormer: Transformer Makes CNN Work Better for Scribble-based Medical Image Segmentation

方法:论文提出了一种基于Transformer的模型ScribFormer,通过融合CNN和Transformer的局部特征和全局表示,以及使用注意力引导的类别激活图(ACAM)分支,实现了高质量像素级分割结果。

创新点:

-

ScribFormer是第一个使用Transformer的scribble监督医学图像分割模型,通过利用Transformer分支的注意力权重来改善卷积特征和CNN分支生成的ACAMs的性能。

-

ScribFormer通过整合CNN和Transformer分支的优势,并使用通道和空间注意力调制来提高模型对复杂特征相互连接的理解能力,从而有效地提高了模型的性能和精确度。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“融合新17”获取全部论文+代码

码字不易,欢迎大家点赞评论收藏