ElasticSearch系列-索引原理与数据读写流程详解

索引原理

倒排索引

倒排索引(Inverted Index)也叫反向索引,有反向索引必有正向索引。通俗地来讲,正向索引是通过key找value,反向索引则是通过value找key。ES底层在检索时底层使用的就是倒排索引。

索引模型

现有索引和映射如下:

{"products" : {"mappings" : {"properties" : {"description" : {"type" : "text"},"price" : {"type" : "float"},"title" : {"type" : "keyword"}}}}

}

先录入如下数据,有三个字段title、price、description等

| _id | title | price | description |

|---|---|---|---|

| 1 | 蓝月亮洗衣液 | 19.9 | 蓝月亮洗衣液很高效 |

| 2 | iphone13 | 19.9 | 很不错的手机 |

| 3 | 小浣熊干脆面 | 1.5 | 小浣熊很好吃 |

在ES中除了text类型分词,其他类型不分词,因此根据不同字段创建索引如下:

-

title字段:

term _id(文档id) 蓝月亮洗衣液 1 iphone13 2 小浣熊干脆面 3 -

price字段

term _id(文档id) 19.9 [1,2] 1.5 3 -

description字段

term _id term _id term _id 蓝 1 不 2 小 3 月 1 错 2 浣 3 亮 1 的 2 熊 3 洗 1 手 2 好 3 衣 1 机 2 吃 3 液 1 很 [1:1:9,2:1:6,3:1:6] 高 1 效 1

注意: Elasticsearch分别为每个字段都建立了一个倒排索引。因此查询时查询字段的term,就能知道文档ID,就能快速找到文档。

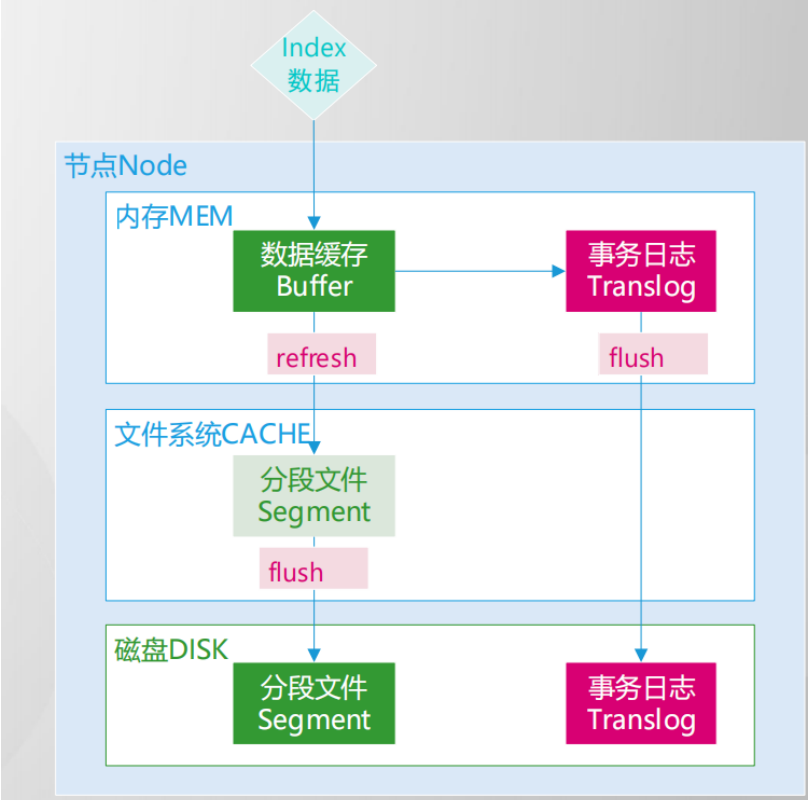

数据写入流程

-

先写入buffer,在buffer里的时候数据是搜索不到的;同时将数据写入translog日志文件

-

如果buffer快满了,或者到一定时间,就会将buffer数据refresh到一个新的segment file中,但是此时数据不是直接进入segment file的磁盘文件的,而是先进入os cache的。这个过程就是refresh。为什么叫es是准实时的?NRT,near real-time,准实时。默认是每隔1秒refresh一次的,所以es是准实时的,因为写入的数据1秒之后才能被看到。

-

只要数据进入os cache,此时就可以让这个segment file的数据对外提供搜索了

-

重复1~3步骤,新的数据不断进入buffer和translog,不断将buffer数据写入一个又一个新的segment file中去,每次refresh完buffer清空,translog保留。随着这个过程推进,translog会变得越来越大。当translog达到一定长度的时候,就会触发mit操作。

-

mit操作发生第一步,就是将buffer中现有数据refresh到os cache中去,清空buffer

-

将一个mit point写入磁盘文件,里面标识着这个mit point对应的所有segment file

-

强行将os cache中目前所有的数据都fsync到磁盘文件中

-

将现有的translog清空,然后再次重启启用一个translog,此时mit操作完成。默认每隔30分钟会自动执行一次mit,但是如果translog过大,也会触发mit。整个mit的过程,叫做flush操作。我们可以手动执行flush操作,就是将所有os cache数据刷到磁盘文件中去。

es中的flush操作,就对应着mit的全过程。我们也可以通过es api,手动执行flush操作,手动将os cache中的数据fsync强刷到磁盘上去,记录一个mit point,清空translog日志文件。

-

translog其实也是先写入os cache的,默认每隔5秒刷一次到磁盘中去,所以默认情况下,可能有5秒的数据会仅仅停留在buffer或者translog文件的os cache中,如果此时机器挂了,会丢失5秒钟的数据。但是这样性能比较好,最多丢5秒的数据。也可以将translog设置成每次写操作必须是直接fsync到磁盘,但是性能会差很多。

-

如果是删除操作,mit的时候会生成一个.del文件,里面将某个doc标识为deleted状态,那么搜索的时候根据.del文件就知道这个doc被删除了

-

如果是更新操作,就是将原来的doc标识为deleted状态,然后新写入一条数据

-

buffer每次refresh一次,就会产生一个segment file,所以默认情况下是1秒钟一个segment file,segment file会越来越多,此时会定期执行merge

-

每次merge的时候,会将多个segment file合并成一个,同时这里会将标识为deleted的doc给物理删除掉,然后将新的segment file写入磁盘,这里会写一个mit point,标识所有新的segment file,然后打开segment file供搜索使用,同时删除旧的segment file。

es里的写流程,有4个底层的核心概念,refresh、flush、translog、merge

当segment file多到一定程度的时候,es就会自动触发merge操作,将多个segment file给merge成一个segment file。

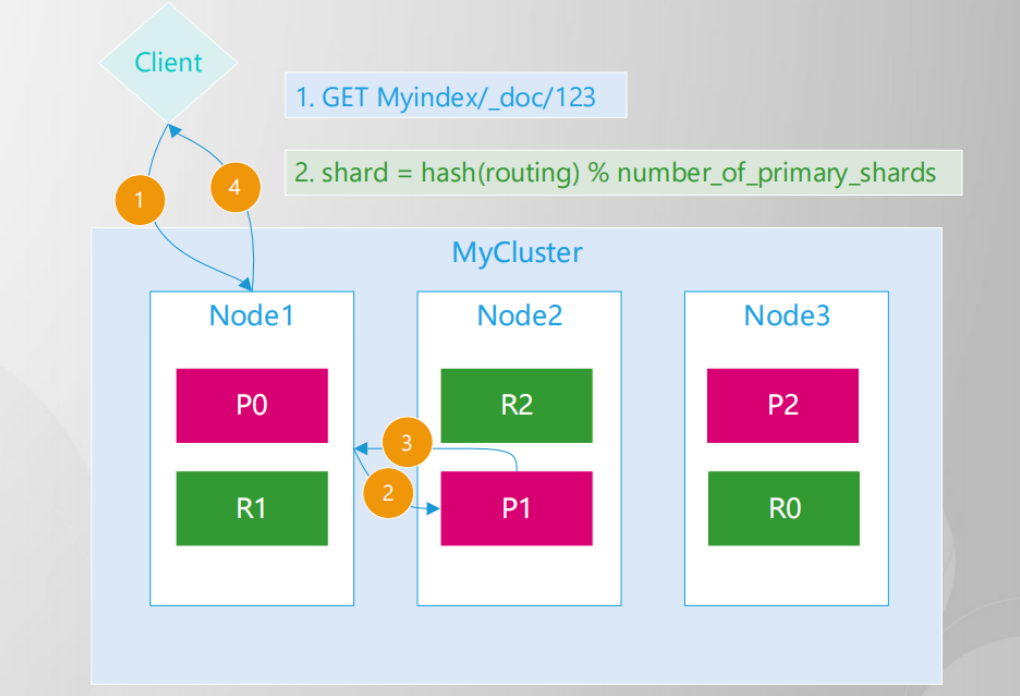

数据查询流程

-

客户端发送请求到任意一个node,成为coordinate node

-

coordinate node对document进行路由,将请求转发到对应的node,此时会使用round-robin随机轮询算法,在primary shard以及其所有replica中随机选择一个,让读请求负载均衡

-

接收请求的node返回document给coordinate node

-

coordinate node返回document给客户端

今天的分享就到这里,喜欢的朋友可以点赞收藏,感谢!!