机器学习深度学习——多层感知机的简洁实现

👨🎓作者简介:一位即将上大四,正专攻机器学习的保研er

🌌上期文章:机器学习&&深度学习——多层感知机的从零开始实现

📚订阅专栏:机器学习&&深度学习

希望文章对你们有所帮助

之前的数学推导或者思维构建的过程是很慢的,而今天的进度却很快。这是今天的第五篇文章了,说明基础和思想慢慢掌握一点以后,直接开始起飞了,大家一起加油。

多层感知机的简洁实现

- 模型

- 训练

其实就是通过高级API来实现:

import torch

from torch import nn

from d2l import torch as d2l

模型

与之前的softmax回归相比,唯一区别就是我们添加了2个全连接层,之前只有1个。第一层是隐藏层,包含了256个隐藏单元,且使用了ReLU函数;第二层是输出层:

net = nn.Sequential(nn.Flatten(),nn.Linear(784, 256),nn.ReLU(),nn.Linear(256, 10))def init_weights(m):if type(m) == nn.Linear:nn.init.normal_(m.weight, std=0.01)net.apply(init_weights)

其中,nn.Sequential的操作表明,先进行Flatten进行展平,再将784放到隐藏层变为256个单元(使用的全连接的方式),隐藏层这时候要执行nn.ReLU(),接着再放到全连接到输出层,输出10个。

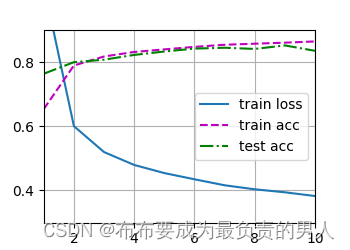

训练

训练过程的实现与我们实现softmax回归时完全相同, 这种模块化设计使我们能够将与模型架构有关的内容独立出来。

batch_size, lr, num_epochs = 256, 0.1, 10

loss = nn.CrossEntropyLoss(reduction='none')

trainer = torch.optim.SGD(net.parameters(), lr=lr)train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

d2l.plt.show()