深度学习-卷积神经网络-NIN

网络结构是卷积神经网络(CNN)发展的关键。其中,网络结构的改进至关重要。本文将介绍一种具有创新意义的卷积神经网络——NIN(Network in Network)。

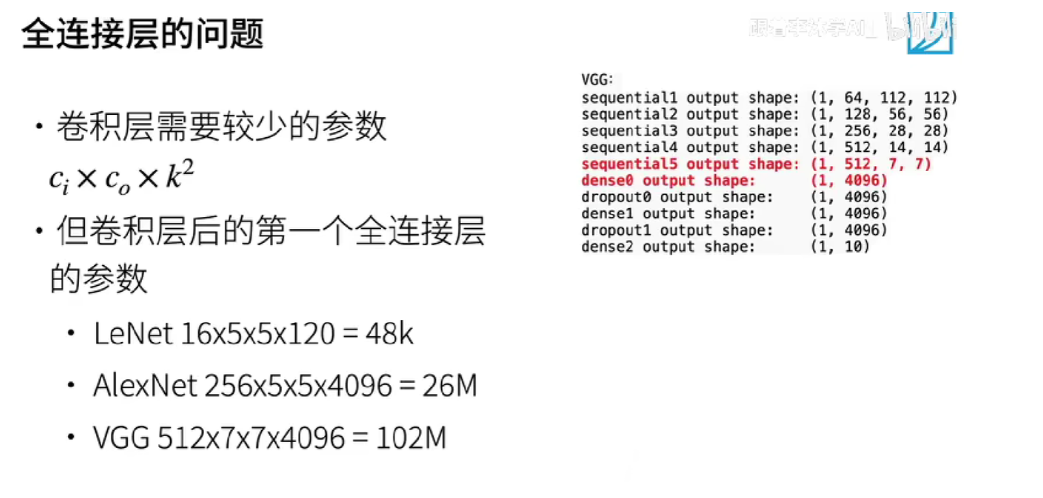

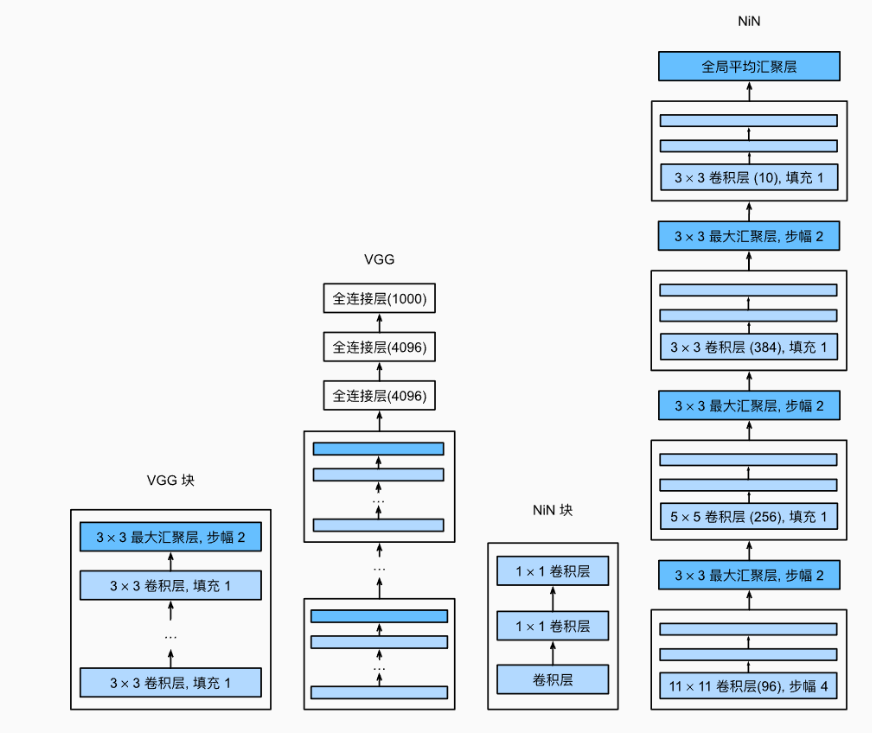

LeNet、AlexNet和VGG都有一个共同的设计模式:通过一系列的卷积层与汇聚层来提取空间结构特征;然后通过全连接层对特征的表征进行处理。

AlexNet和VGG对LeNet的改进主要在于如何扩大和加深这两个模块。 或者,可以想象在这个过程的早期使用全连接层。然而,如果使用了全连接层,可能会完全放弃表征的空间结构。

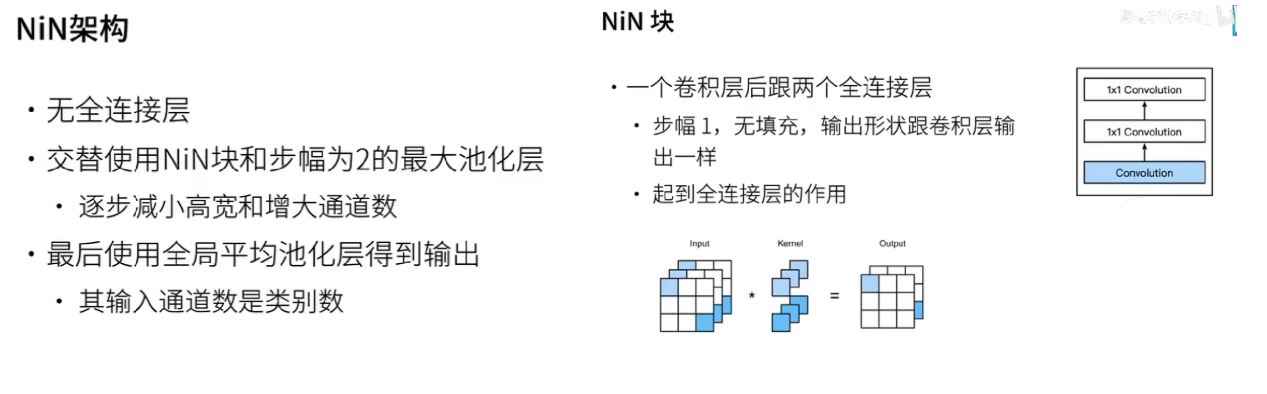

网络中的网络NiN 提供了一个非常简单的解决方案:在每个像素的通道上分别使用多层感知机。

1. 网络结构组成

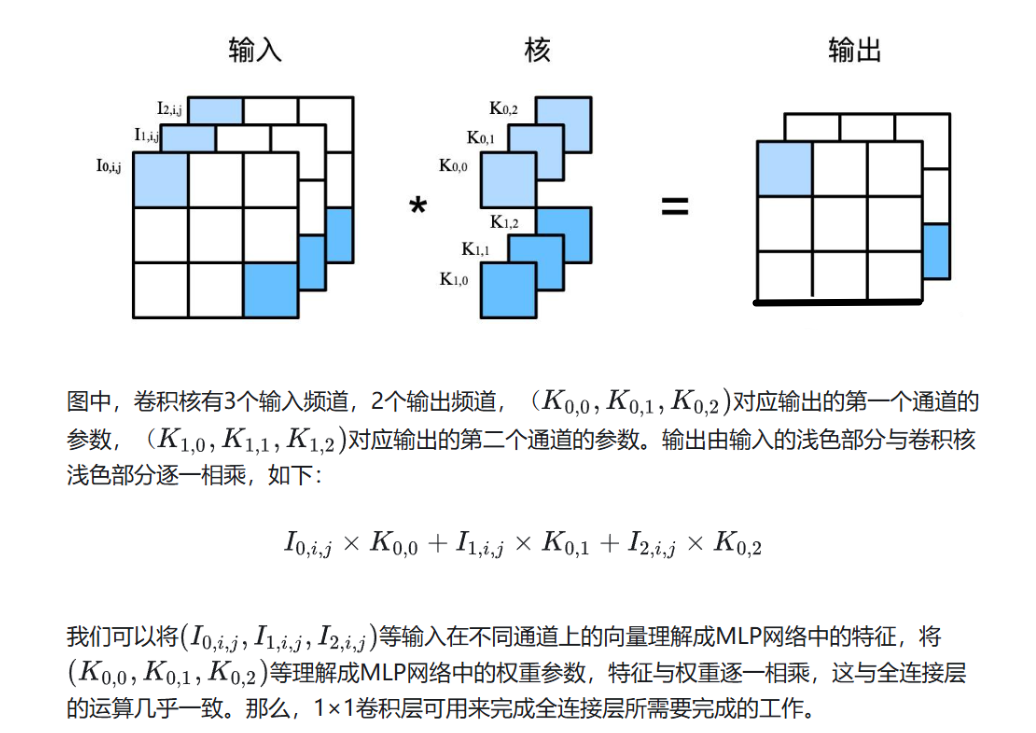

NiN块 使用了1×1的卷积层代表全连接层。

NIN的核心创新在于引入了“微网络”(Network in Network)的概念。具体来说,每个卷积层后面都跟随着一个1×1卷积核的微型网络,用于对特征图进行逐像素的特征变换,增加了网络的非线性表达能力。这种设计使得模型能够更深入地挖掘和利用特征信息。

与传统的卷积神经网络相比,NIN的结构设计更加紧凑,能够以较少的参数实现更好的性能。其主要特点如下:

1×1卷积层的应用:通过1×1卷积核对特征图进行逐像素的特征变换,增加模型的非线性表达能力。

全局平均池化层:在最后一层使用全局平均池化层代替全连接层,降低参数数量,减少过拟合风险,提高模型的泛化能力。

网络深度的优化:NIN通过增加网络的深度来提高模型的特征提取能力,同时保持了模型的简洁性。

2. 代码实现

代码改编自《动手学深度学习》

import torch

from torch import nn

from d2l import torch as d2ldef nin_block(in_channels, out_channels, kernel_size, strides, padding):return nn.Sequential(nn.Conv2d(in_channels, out_channels, kernel_size, strides, padding),nn.ReLU(),nn.Conv2d(out_channels, out_channels, kernel_size=1), nn.ReLU(),nn.Conv2d(out_channels, out_channels, kernel_size=1), nn.ReLU())

net = nn.Sequential(nin_block(1, 96, kernel_size=11, strides=4, padding=0),nn.MaxPool2d(3, stride=2),nin_block(96, 256, kernel_size=5, strides=1, padding=2),nn.MaxPool2d(3, stride=2),nin_block(256, 384, kernel_size=3, strides=1, padding=1),nn.MaxPool2d(3, stride=2),nn.Dropout(0.5),# 标签类别数是10nin_block(384, 10, kernel_size=3, strides=1, padding=1),nn.AdaptiveAvgPool2d((1, 1)),# 将四维的输出转成二维的输出,其形状为(批量大小,10)nn.Flatten())

X = torch.rand(size=(1, 1, 224, 224))

for layer in net:X = layer(X)print(layer.__class__.__name__,'output shape:\t', X.shape)输出:

Sequential output shape: torch.Size([1, 96, 54, 54])

MaxPool2d output shape: torch.Size([1, 96, 26, 26])

Sequential output shape: torch.Size([1, 256, 26, 26])

MaxPool2d output shape: torch.Size([1, 256, 12, 12])

Sequential output shape: torch.Size([1, 384, 12, 12])

MaxPool2d output shape: torch.Size([1, 384, 5, 5])

Dropout output shape: torch.Size([1, 384, 5, 5])

Sequential output shape: torch.Size([1, 10, 5, 5])

AdaptiveAvgPool2d output shape: torch.Size([1, 10, 1, 1])

Flatten output shape: torch.Size([1, 10])

lr, num_epochs, batch_size = 0.1, 10, 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())输出:

loss 0.563, train acc 0.786, test acc 0.790

3087.6 examples/sec on cuda:03. NIN的影响

NIN在多个图像分类任务中表现出了显著的性能提升。通过在ImageNet数据集上的实验验证,NIN在Top-5错误率上达到了较低的水平,证明了其在图像分类任务中的有效性。此外,NIN的结构设计使其适用于各种计算机视觉任务,包括目标检测和图像分割等。

与其他卷积神经网络架构相比,NIN在网络结构和性能上具有以下优势:

更少的参数:NIN通过减少全连接层的数量,显著降低了模型的参数数量。

更高的效率:由于参数数量的减少,NIN在训练和推理过程中更加高效。

更好的泛化能力:全局平均池化层的使用提高了模型对新数据的适应能力。

NiN 使用由一个卷积层和多个1×1卷积层组成的块。

NiN块 可以在卷积神经网络中使用,以允许更多的每像素非线性。

NiN去除了容易造成过拟合的全连接层,将它们替换为全局平均汇聚层(即在所有位置上进行求和)。该汇聚层通道数量为所需的输出数量(例如,Fashion-MNIST的输出为10)。

移除全连接层可减少过拟合,同时显著减少NiN的参数。

NiN的设计影响了许多后续卷积神经网络的设计。