Ollama系列---【ollama使用gpu运行大模型】

一、安装CudaToolkit

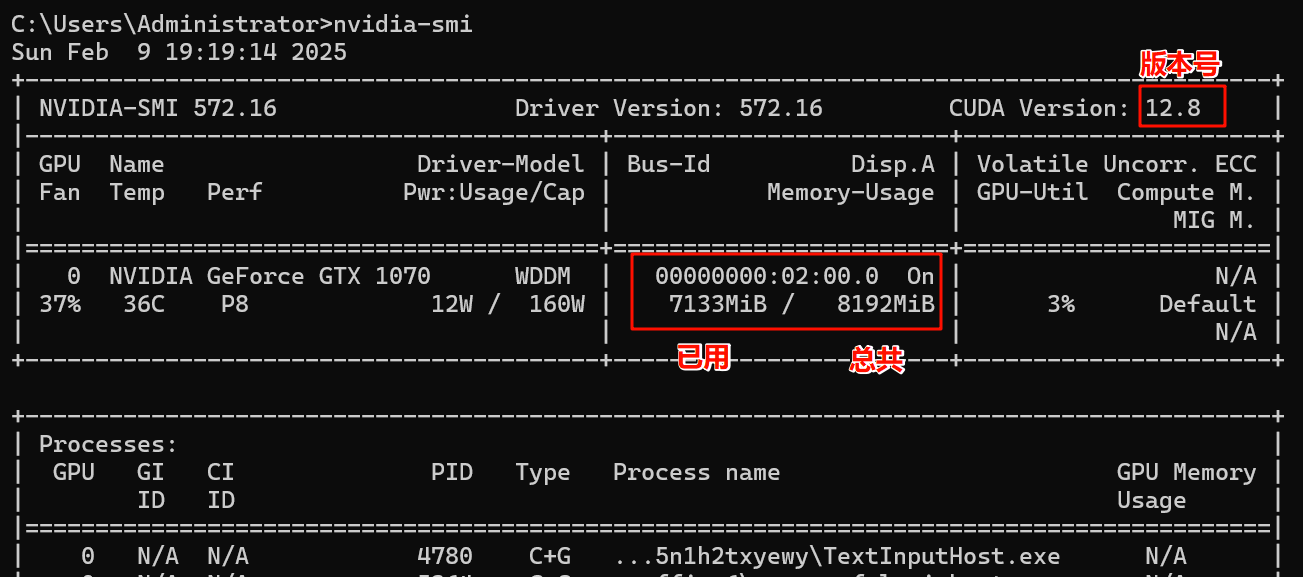

使用控制台命令查看当前显卡驱动中的cuda版本

nvidia-smi

二、下载CudaToolkit

注意:CudaToolkit版本要低于上面的显卡Cuda版本。

Cuda各版本下载地址:CUDA Toolkit Archive | NVIDIA Developer

下载好之后,一路下一步,一直默认即可。

如果安装到了自定义的位置,记得加环境变量。这里我安装到了D盘,下面是我添加的环境变量。

三、验证是否安装成功

nvcc --version安装成功,如下图:

四、设置Ollama环境变量

Ollama安装好后,为了让推理跑在GPU上,可以按照如下步骤 设置环境变量:

在“系统变量”中,点击“新建”按钮。

添加以下环境变量:

变量名:OLLAMA_GPU_LAYER

变量值:cuda

如果需要指定特定的 GPU,可以添加以下环境变量:

变量名:CUDA_VISIBLE_DEVICES

变量值:GPU的UUID(按编号有时找不到,所以使用UUID)

在控制台输入nvidia-smi -L,即可查看GPU的UUID

五、查看ollama是否使用了gpu

通过观察PROCESSOR就能看到,大模型是用的cpu还是gpu,还是混合的。

ollama ps经验证:8G的显卡,跑8b的模型可以100%用GPU,非常流畅。跑14b的cpu和gpu基本4/6开,可以观察SIZE模型运行需要的大小。