Elasticsearch集群和Logstash、Kibana部署

1、 Elasticsearch集群部署

-

服务器

| 安装软件 | 主机名 | IP地址 | 系统版本 | 配置 |

|---|---|---|---|---|

| Elasticsearch | Elk | 10.3.145.14 | centos7.5.1804 | 2核4G |

| Elasticsearch | Es1 | 10.3.145.56 | centos7.5.1804 | 2核3G |

| Elasticsearch | Es2 | 10.3.145.57 | centos7.5.1804 | 2核3G |

-

软件版本:elasticsearch-7.13.2.tar.gz

-

示例节点:10.3.145.14

1、安装配置jdk

可以自行安装,es安装包中自带了jdk

2、安装配置ES

(1)创建运行ES的普通用户

[root@elk ~]# useradd es

[root@elk ~]# echo "******" | passwd --stdin "es"(2)安装配置ES

[root@elk ~]# tar zxvf /usr/local/package/elasticsearch-7.13.2-linux-x86_64.tar.gz -C /usr/local/

[root@elk ~]# mv /usr/local/elasticsearch-7.13.2 /usr/local/es

[root@elk ~]# vim /usr/local/es/config/elasticsearch.yml

cluster.name: bjbpe01-elk

cluster.initial_master_nodes: ["192.168.1.101","192.168.1.102","192.168.1.103"] # 单节点模式这里的地址只填写本机地址

node.name: elk01

node.master: true

node.data: true

path.data: /data/elasticsearch/data

path.logs: /data/elasticsearch/logs

bootstrap.memory_lock: false

bootstrap.system_call_filter: false

network.host: 0.0.0.0

http.port: 9200

transport.tcp.port: 9300

# 单节点模式下,将discovery开头的行注释

discovery.seed_hosts: ["192.168.1.102","192.168.1.103"]

discovery.zen.minimum_master_nodes: 2

discovery.zen.ping_timeout: 150s

discovery.zen.fd.ping_retries: 10

client.transport.ping_timeout: 60s

http.cors.enabled: true

http.cors.allow-origin: "*"配置项含义

cluster.name 集群名称,各节点配成相同的集群名称。

cluster.initial_master_nodes 集群ip,默认为空,如果为空则加入现有集群,第一次需配置

node.name 节点名称,各节点配置不同。

node.master 指示某个节点是否符合成为主节点的条件。

node.data 指示节点是否为数据节点。数据节点包含并管理索引的一部分。

path.data 数据存储目录。

path.logs 日志存储目录。

bootstrap.memory_lock 内存锁定,是否禁用交换,测试环境建议改为false。

bootstrap.system_call_filter 系统调用过滤器。

network.host 绑定节点IP。

http.port rest api端口。

discovery.seed_hosts 提供其他 Elasticsearch 服务节点的单点广播发现功能,这里填写除了本机的其他ip

discovery.zen.minimum_master_nodes 集群中可工作的具有Master节点资格的最小数量,官方的推荐值是(N/2)+1,其中N是具有master资格的节点的数量。

discovery.zen.ping_timeout 节点在发现过程中的等待时间。

discovery.zen.fd.ping_retries 节点发现重试次数。

http.cors.enabled 是否允许跨源 REST 请求,用于允许head插件访问ES。

http.cors.allow-origin 允许的源地址。(3)设置JVM堆大小#7.0默认为4G

[root@elk ~]# sed -i 's/## -Xms4g/-Xms4g/' /usr/local/es/config/jvm.options

[root@elk ~]# sed -i 's/## -Xmx4g/-Xmx4g/' /usr/local/es/config/jvm.options注:确保堆内存最小值(Xms)与最大值(Xmx)的大小相同,防止程序在运行时改变堆内存大小。

如果系统内存足够大,将堆内存最大和最小值设置为31G,因为有一个32G性能瓶颈问题。

堆内存大小不要超过系统内存的50%(4)创建ES数据及日志存储目录

[root@elk ~]# mkdir -p /data/elasticsearch/data

[root@elk ~]# mkdir -p /data/elasticsearch/logs (5)修改安装目录及存储目录权限

[root@elk ~]# chown -R es.es /data/elasticsearch

[root@elk ~]# chown -R es.es /usr/local/es3、系统优化

(1)增加最大文件打开数

[root@elk ~]# echo "* soft nofile 65536" >> /etc/security/limits.conf(2)增加最大进程数

[root@elk ~]# echo "* soft nproc 65536" >> /etc/security/limits.conf或者

* soft nofile 65536

* hard nofile 131072

* soft nproc 4096

* hard nproc 4096

更多的参数调整可以直接用这个(3)增加最大内存映射数

[root@elk ~]# echo "vm.max_map_count=262144" >> /etc/sysctl.conf

[root@elk ~]# sysctl -p(4)启动遇到下面问题解决办法

memory locking requested for elasticsearch process but memory is not locked

elasticsearch.yml文件

bootstrap.memory_lock : false

/etc/sysctl.conf文件

vm.swappiness=0错误:

max file descriptors [4096] for elasticsearch process is too low, increase to at least [65536]意思是elasticsearch用户拥有的客串建文件描述的权限太低,知道需要65536个解决:切换到root用户下面,[root@elk ~]# vim /etc/security/limits.conf在最后添加

* hard nofile 65536

* hard nproc 65536

重新启动elasticsearch,还是无效?

必须重新登录启动elasticsearch的账户才可以,例如我的账户名是elasticsearch,退出重新登录。

另外*也可以换为启动elasticsearch的账户也可以,* 代表所有,其实比较不合适启动还会遇到另外一个问题,就是

max virtual memory areas vm.max_map_count [65530] is too low, increase to at least [262144]

意思是:elasticsearch用户拥有的内存权限太小了,至少需要262114。这个比较简单,也不需要重启,直接执行

sysctl -w vm.max_map_count=262144

就可以了4、启动ES

以ES用户启动

[root@elk ~]# su - es -c "cd /usr/local/es && nohup bin/elasticsearch &"测试:浏览器访问http://10.3.145.14:9200

5.安装配置head监控插件 (只在第一台es部署)

-

服务器

| 安装软件 | 主机名 | IP地址 | 系统版本 | 配置 |

|---|---|---|---|---|

| Elasticsearch-head-master |

(1)安装node

[root@elk ~]# wget https://npm.taobao.org/mirrors/node/latest-v10.x/node-v10.0.0-linux-x64.tar.gz

[root@elk ~]# tar -zxf node-v10.0.0-linux-x64.tar.gz –C /usr/local

[root@elk ~]# echo "

NODE_HOME=/usr/local/node-v10.0.0-linux-x64

PATH=\$NODE_HOME/bin:\$PATH

export NODE_HOME PATH

" >>/etc/profile

[root@elk ~]# source /etc/profile

[root@elk ~]# node --version #检查node版本号(2)下载head插件

[root@elk ~]# wget https://github.com/mobz/elasticsearch-head/archive/master.zip

[root@elk ~]# unzip -d /usr/local elasticsearch-head-master.zip(3)安装grunt

[root@elk ~]# cd /usr/local/elasticsearch-head-master

[root@elk elasticsearch-head-master]# npm install -g grunt-cli

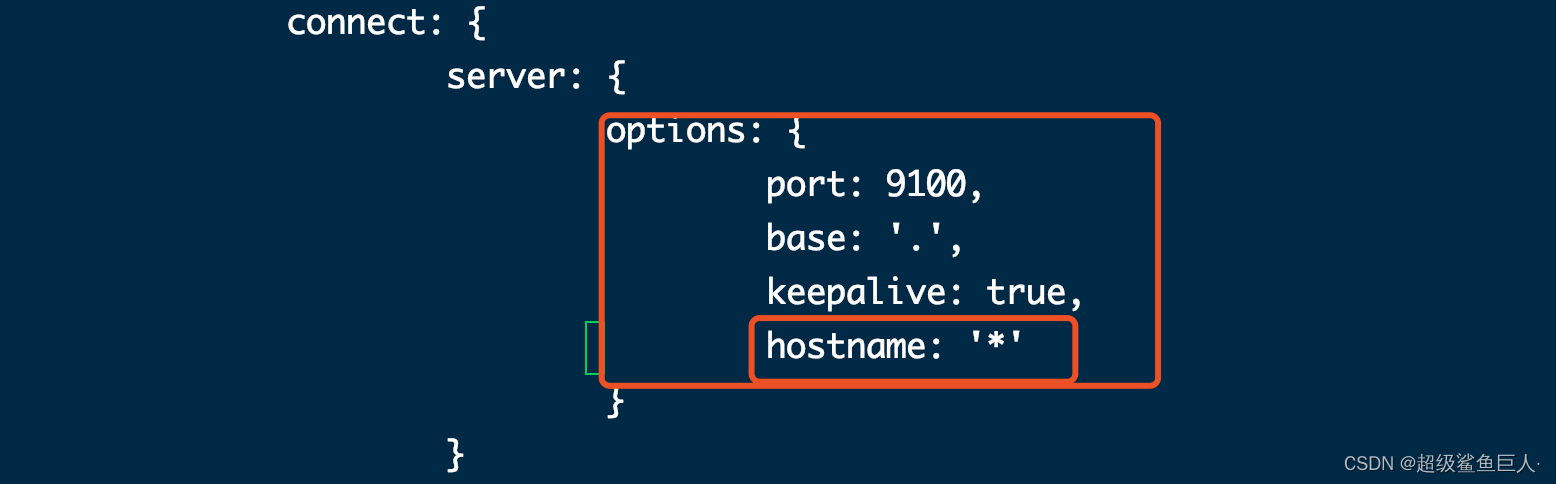

[root@elk elasticsearch-head-master]# grunt -version #检查grunt版本号(4)修改head源码

[root@elk ~]# vi /usr/local/elasticsearch-head-master/Gruntfile.js +99

添加hostname,注意在上一行末尾添加逗号,hostname 不需要添加逗号

[root@elk ~]# vim /usr/local/elasticsearch-head-master/_site/app.js +4388

原本是http://localhost:9200,如果head和ES不在同一个节点,注意修改成ES的IP地址

(5)下载head必要的文件

[root@elk ~]# wget https://github.com/Medium/phantomjs/releases/download/v2.1.1/phantomjs-2.1.1-linux-x86_64.tar.bz2

[root@elk ~]# yum -y install bzip2

[root@elk ~]# mkdir /tmp/phantomjs

[root@elk ~]# mv phantomjs-2.1.1-linux-x86_64.tar.bz2 /tmp/phantomjs/

[root@elk ~]# chmod 777 /tmp/phantomjs -R(6)运行head

[root@elk ~]# cd /usr/local/elasticsearch-head-master/

[root@elk elasticsearch-head-master]# npm install

[root@elk elasticsearch-head-master]# nohup grunt server &

[root@elk elasticsearch-head-master]# ss -tnlp

nohup grunt server --allow-root &

npm install 执行错误解析:

npm ERR! code ELIFECYCLE

npm ERR! errno 1

npm ERR! phantomjs-prebuilt@2.1.16 install: `node install.js`

npm ERR! Exit status 1

npm ERR!

npm ERR! Failed at the phantomjs-prebuilt@2.1.16 install script.

npm ERR! This is probably not a problem with npm. There is likely additional logging output above.npm ERR! A complete log of this run can be found in:

npm ERR! /root/.npm/_logs/2021-04-21T09_49_34_207Z-debug.log解决:

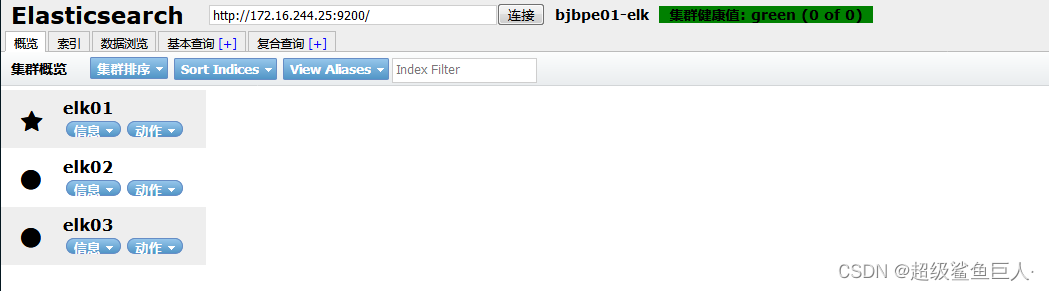

[root@elk elasticsearch-head-master]# npm install phantomjs-prebuilt@2.1.16 --ignore-scripts # 具体的版本按照上述报错修改(7)测试

访问http://10.3.145.14:9100

2. Logstash部署

-

服务器

| 安装软件 | 主机名 | IP地址 | 系统版本 | 配置 |

|---|---|---|---|---|

| Logstash | Elk | 10.3.145.14 | centos7.5.1804 | 2核4G |

-

软件版本:logstash-7.13.2.tar.gz

1.安装配置Logstash

Logstash运行同样依赖jdk,本次为节省资源,故将Logstash安装在了10.3.145.14节点。

(1)安装

[root@elk ~]# tar zxf /usr/local/package/logstash-7.13.2.tar.gz -C /usr/local/(2)测试文件

标准输入=>标准输出及es集群

1、启动logstash

2、启动后直接在终端输入数据

3、数据会由logstash处理后返回并存储到es集群中

input {tcp {port => 8888}

}

filter {grok {match => {"message" => "%{DATA:key} %{NUMBER:value:int}"} }

}

output {stdout {codec => rubydebug}elasticsearch {hosts => ["10.3.145.14","10.3.145.56","10.3.145.57"]index => 'logstash-debug-%{+YYYY-MM-dd}'}

}(3)启动

[root@elk ~]# cd /usr/local/logstash-7.13.2

[root@elk ~]# nohup bin/logstash -f etc/conf.d/ --config.reload.automatic &3、Kibana部署

-

服务器

| 安装软件 | 主机名 | IP地址 | 系统版本 | 配置 |

|---|---|---|---|---|

| Kibana | Elk | 10.3.145.14 | centos7.5.1804 | 2核4G |

| 软件版本:nginx-1.14.2、kibana-7.13.2-linux-x86_64.tar.gz |

1. 安装配置Kibana

(1)安装

[root@elk ~]# tar zxf kibana-7.13.2-linux-x86_64.tar.gz -C /usr/local/(2)配置

[root@elk ~]# echo '

server.port: 5601

server.host: "192.168.181.128"

elasticsearch.hosts: ["http://192.168.181.128:9200"]

kibana.index: ".kibana"

i18n.locale: "zh-CN"

'>>/usr/local/kibana-7.13.2-linux-x86_64/config/kibana.yml含义:

server.port kibana服务端口,默认5601

server.host kibana主机IP地址,默认localhost

elasticsearch.url 用来做查询的ES节点的URL,默认http://localhost:9200

kibana.index kibana在Elasticsearch中使用索引来存储保存的searches, visualizations和dashboards,默认.kibana(3)启动

[root@elk ~]# cd /usr/local/kibana-7.13.2-linux-x86_64/

[root@elk ~]# nohup ./bin/kibana &

./bin/kibana --allow-root4、Filebeat部署

为什么用 Filebeat ,而不用原来的 Logstash 呢?

原因很简单,资源消耗比较大。

由于 Logstash 是跑在 JVM 上面,资源消耗比较大,后来作者用 GO 写了一个功能较少但是资源消耗也小的轻量级的 Agent 叫 Logstash-forwarder。

后来作者加入 elastic.co 公司, Logstash-forwarder 的开发工作给公司内部 GO 团队来搞,最后命名为 Filebeat。

Filebeat 需要部署在每台应用服务器上,可以通过 Salt 来推送并安装配置。

-

服务器

| 安装软件 | 主机名 | IP地址 | 系统版本 | 配置 |

|---|---|---|---|---|

| filebeat | Kafka3 | 10.3.145.43 | centos7.5.1804 | 1核2G |

-

软件版本 filebeat-7.13.2-x86_64.rpm

(1)下载

[root@kafka3 ~]# curl -L -O https://artifacts.elastic.co/downloads/beats/filebeat/filebeat-7.13.2-x86_64.rpm(2)解压

[root@kafka3 ~]# yum install -y filebeat-7.13.2-x86_64.rpm(3)修改配置

修改 Filebeat 配置,支持收集本地目录日志,并输出日志到 Kafka 集群中

[root@kafka3 ~]# vim filebeat.yml

filebeat.inputs:

- type: logenabled: truepaths:- /var/log/nginx/access.log

output.logstash:hosts: ["10.3.145.14:5000"]output.kafka: hosts: ["10.3.145.41:9092","10.3.145.42:9092","10.3.145.43:9092"]topic: 'nginx'# 注意,如果需要重新读取,请删除/data/registry目录 (4)启动

[root@kafka3 ~]# ./filebeat -e -c filebeat.yml