什么是神经网络?

一、什么是神经网络?

神经网络又称人工神经网络,是一种基于人脑功能模型的计算架构,因此称之为“神经”。神经网络由一组称为“节点”的处理单元组成。这些节点相互传递数据,就像大脑中的神经元相互传递电脉冲一样。

神经网络在机器学习中使用;机器学习是指一种无需明确指令即可学习的计算机程序。具体来说,神经网络在深度学习中使用;深度学习是一种先进的机器学习类型,无需人工干预即可从无标签数据中得出结论。例如,在神经网络基础上建立的深度学习模型在获得足够的训练数据后,就能识别出照片中从未见过的物品。

神经网络使多种类型的人工智能 (AI) 成为可能。大型语言模型 (LLM)(如 ChatGPT)、AI 图像生成器(如 DALL-E)和预测式 AI 模型都在一定程度上依赖于神经网络。

二、神经网络如何工作?

神经网络由一系列节点组成。节点至少分布在三个层上。这三个层分别是:

- 输入层

- “隐藏”层

- 输出层

神经网络至少必须包含这三个层。除了输入层和输出层,神经网络还可以有多个隐藏层。

无论属于哪一层,每个节点都会对从上一层节点(或输入层)接收到的输入执行某种处理任务或功能。基本上,每个节点都包含一个数学公式,公式中每个变量的权重各不相同。如果将该数学公式应用于输入产生的输出超过了某个阈值,该节点就会将数据传递给神经网络的下一层。如果输出低于阈值,则不会将数据传递给下一层。

想象一下,Acme 公司有一个等级森严的会计部。Acme 会计部经理级员工批准低于 1,000 美元的支出,董事批准低于 10,000 美元的支出,首席财务官批准任何超过 10,000 美元的支出。Acme 公司其他部门的员工在提交费用时,首先要提交给会计经理。任何超过 1000 美元的支出都会转给董事,而低于 1000 美元的支出则留在经理一级,以此类推。

Acme 公司会计部的运作方式有点像神经网络。员工提交费用报告就好比是神经网络的输入层。每个经理和总监就好比是神经网络中的一个节点。

就像一位会计经理在将费用报告交给会计主管之前,可能会请另一位经理协助解读报告一样,神经网络也可以用多种方式构建。节点可进行多向通信。

三、有哪些类型的神经网络?

神经网络的节点和层数没有限制,这些节点几乎能够以任何方式进行交互。正因如此,神经网络的类型也在不断增加。不过,它们大致可以分为以下几类:

- 浅层神经网络通常只有一个隐藏层

- 深度神经网络有多个隐藏层

与深度神经网络相比,浅层神经网络速度更快,所需的处理能力更低,但无法像深度神经网络那样执行大量复杂任务。

下面是目前可能使用的神经网络类型的不完整列表:

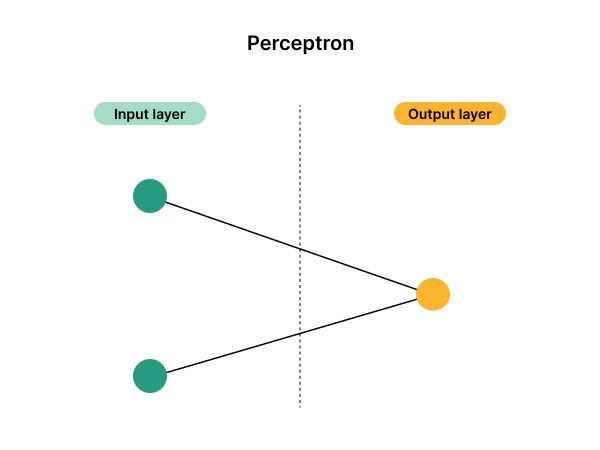

感知器神经网络是一种简单的浅层网络,有一个输入层和一个输出层。

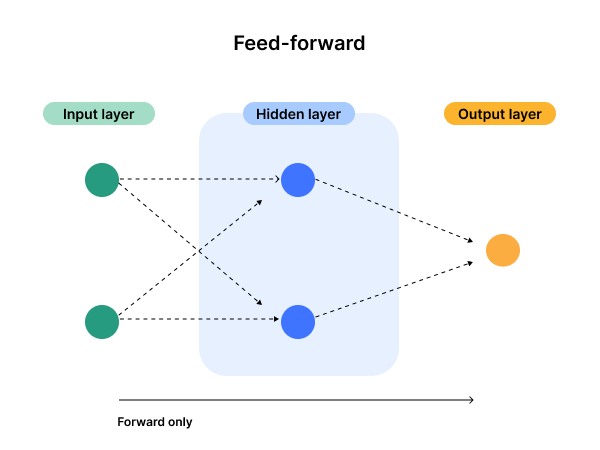

多层感知器神经网络增加了感知器网络的复杂性,并包含一个隐藏层。

前馈神经网络只允许其节点将信息传递给正向节点。

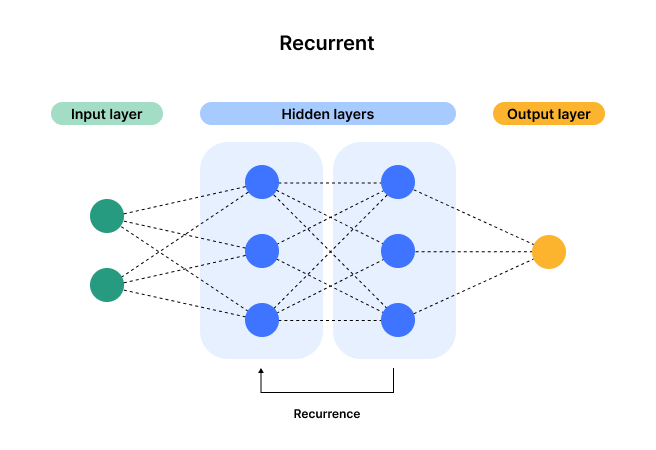

循环神经网络可以倒退,允许某些节点的输出影响之前节点的输入。

模块化神经网络将两个或更多个神经网络组合在一起,以获得输出结果。

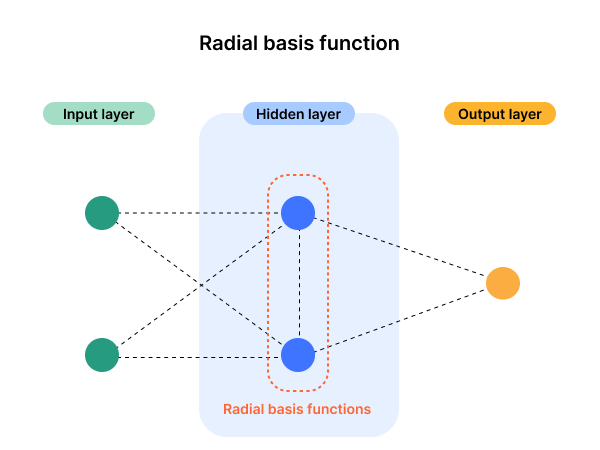

径向基函数神经网络节点使用一种称为径向基函数的特殊数学函数。

液体状态机神经网络的特点是节点之间是随机连接的。

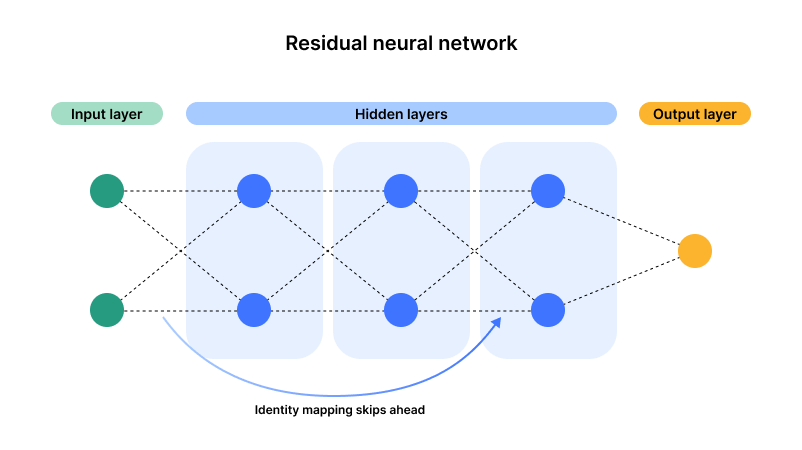

残差神经网络通过一个称为身份映射的过程,将早期层的输出与后期层的输出结合起来,从而使数据向前跳转。

四、什么是 Transformer 神经网络?

Transformer 神经网络之所以值得强调,是因为它们在当今广泛使用的 AI 模型中占据了极其重要的位置。

Transformer 模型于 2017 年首次提出,它是一种神经网络,使用一种名为“自注意力机制”的技术来考虑序列中元素的上下文,而不仅仅是元素本身。通过自注意力机制,它们甚至可以检测到数据集各部分之间的微妙联系。

这种能力使它们非常适合分析(举例来说)文本的句子和段落,而不仅仅是单个单词和短语。在 Transformer 模型被开发出来之前,处理文本的 AI 模型在它们处理到句子末尾时,往往会“忘记”了句子的开头,结果是结合的短语和观点对于人类读者来说是没有意义。然而,Transformer 模型能够以更自然的方式处理和生成人类语言。

Transformer 模型是生成式 AI 不可或缺的组成部分,特别是可以根据人类的任意提示生成文本的 LLM。

五、神经网络的历史

神经网络的历史其实很悠久。神经网络的概念可以追溯到 1943 年的一篇数学论文,该论文对大脑的工作方式进行了建模。在 20 世纪 50 年代和 60 年代,计算机科学家开始尝试构建简单的神经网络,但这一概念最终失宠。在 20 世纪 80 年代,这个概念再次兴起,到 20 世纪 90 年代,神经网络在 AI 研究中得到广泛应用。

不过,直到超高速处理能力、海量数据存储能力和计算资源出现后,神经网络才得以发展到今天的地步,能够模仿甚至超越人类的认知能力。这一领域仍在不断发展;目前使用的最重要的神经网络类型之一 Transformer 可以追溯到 2017 年。