使用jieba库进行中文分词和去除停用词

jieba.lcut

jieba.lcut()和jieba.lcut_for_search()是jieba库中的两个分词函数,它们的功能和参数略有不同。

jieba.lcut()方法接受三个参数:需要分词的字符串,是否使用全模式(默认为False)以及是否使用HMM模型(默认为True)。它返回一个列表,其中包含分词后的词语。该方法适合用于普通的文本分词任务。

而jieba.lcut_for_search()方法接受两个参数:需要分词的字符串和是否使用HMM模型。该方法适合用于搜索引擎的分词,因为它在精确模式的基础上,对长词进行了再次切分,以提高召回率。

import jieba

text = '中文分词是将中文文本切分成一系列有意义的词语的过程。'#定义词典列表

b=['中文分词','中午文本','有意义']

jieba.load_userdict(b) #应用自定义词典列表print(jieba.lcut(text,cut_all=False)) # 默认精确模式,即cut_all=False

print(jieba.lcut(text,cut_all=True)) # 改为全模式,即cut_all=True

print(jieba.lcut_for_search(text)) # 搜索引擎模式

import jiebatext2 = '我们中出了一个叛徒'

print(jieba.lcut(text2))# 删除一个单词

jieba.del_word('中出')

print(jieba.lcut(text2))#增加一个单词

jieba.add_word('出了')

print(jieba.lcut(text2))# 如果我们不想删除“中出”这个词,但是又不想让它合在一起,可以增大它的词频

jieba.add_word('中出') # 为了演示效果,我们需要回到最初始的样子

jieba.del_word('出了')

print(jieba.lcut(text2))

# 调节词的词频,使其能(或不能)被分词

# tune=True:执行词频调整,默认False不执行

jieba.suggest_freq(('中','出'),tune=True)

print(jieba.lcut(text2))

去除停用词语

最全中文停用词表

import re

import jieba

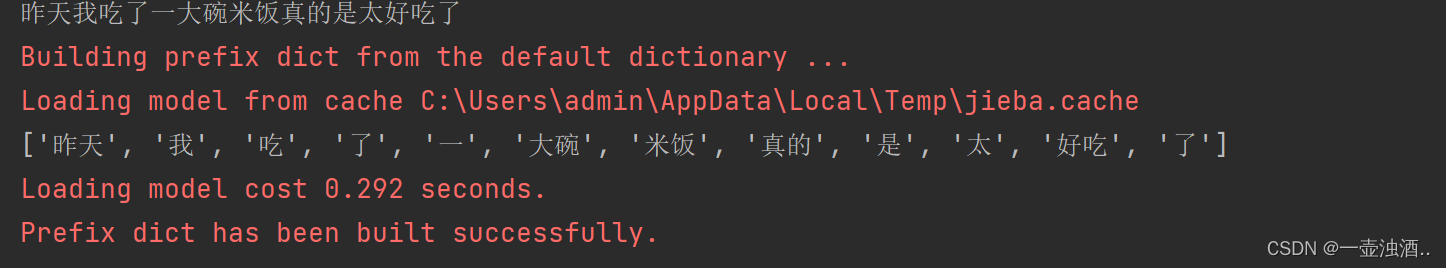

text3 = '昨天我吃了一大碗米饭,真的是太好吃了!###@'# 去除一些无用的字符只提取出中文出来

new_text = "".join(re.findall('[\u4e00-\u9fa5]+', text3, re.S))

print(new_text)print(jieba.lcut(new_text))

综合案例

import re

import jiebadef chinese_word_cut(mytext):# jieba.load_userdict('自定义词典.txt') # 这里你可以添加jieba库识别不了的网络新词,避免将一些新词拆开jieba.initialize() # 初始化jieba# 文本预处理 :去除一些无用的字符只提取出中文出来new_data = re.findall('[\u4e00-\u9fa5]+', mytext, re.S)new_data = " ".join(new_data)# 文本分词seg_list_exact = jieba.lcut(new_data)result_list = []# 读取停用词库with open('cn_stopwords.txt', encoding='utf-8') as f: # 可根据需要打开停用词库,然后加上不想显示的词语con = f.readlines()stop_words = set()for i in con:i = i.replace("\n", "") # 去掉读取每一行数据的\nstop_words.add(i)# 去除停用词并且去除单字for word in seg_list_exact:if word not in stop_words and len(word) > 1:result_list.append(word)return result_listif __name__=='__main__':with open('new.txt','r',encoding='utf-8') as f:text_file=f.read()# 分词得到词典result=chinese_word_cut(text_file)result=set(result)print(result)# print(text_file)

参考:

文本分析-使用jieba库进行中文分词和去除停用词(附案例实战)_jieba.lcut(text)-CSDN博客