[nlp] 损失缩放(Loss Scaling)loss sacle

在深度学习中,由于浮点数的精度限制,当模型参数非常大时,会出现数值溢出的问题,这可能会导致模型训练不稳定。为了解决这个问题,损失缩放(Loss Scaling)技术被引入,它通过缩放损失值来解决这个问题。

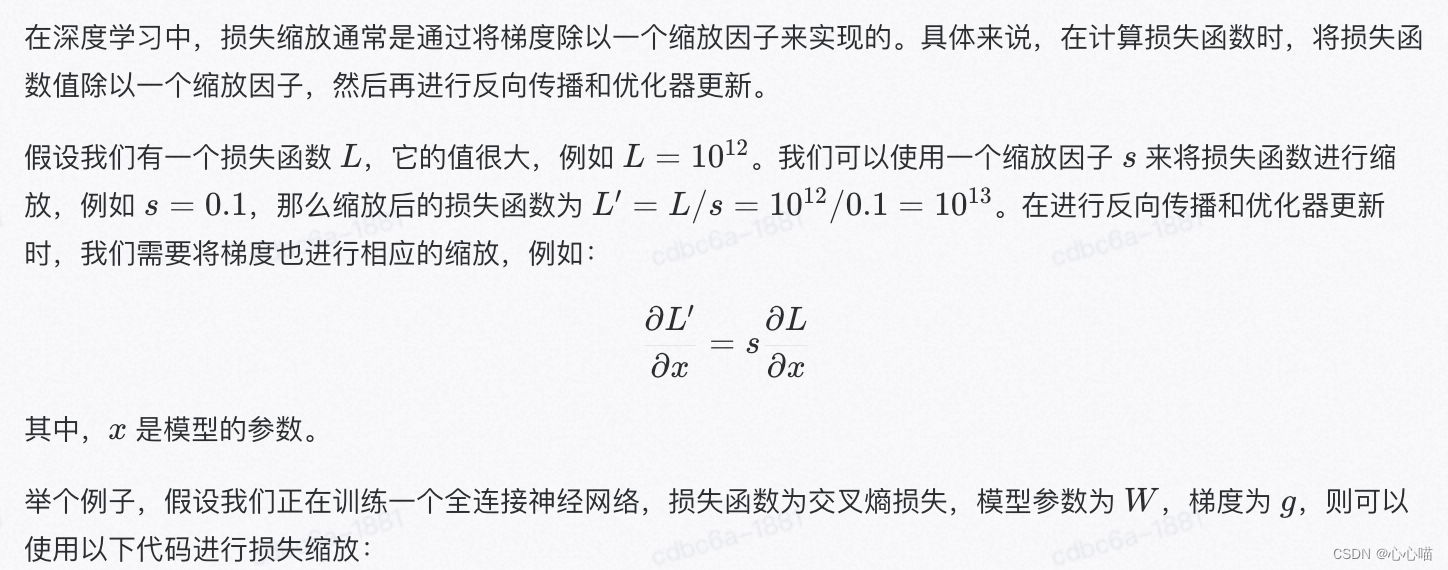

在深度学习中,损失缩放技术通常是通过将梯度进行缩放来实现的。具体来说,在计算梯度时,将梯度除以一个称为“loss scale”的缩放因子,然后再进行反向传播和优化器更新。这种技术可以有效地防止梯度爆炸和消失问题,提高模型的稳定性和收敛速度。

在使用损失缩放技术时,通常需要注意以下几点:

-

缩放因子应该适当,太小会导致模型收敛速度过慢,太大则可能导致梯度爆炸。

-

缩放因子应该在每个迭代步骤中动态调整,以适应模型参数的变化。

-

在使用混合精度训练时,损失缩放技术可以更好地缓解舍入误差,提高模型的稳定性。

总之,损失缩放是一种非常有用的技术,可以帮助深度学习模型更好地训练和收敛。

import torch.nn.utils.gradscale_autograd as gradscale# 定义损失函数

loss_fn = torch.nn.CrossEntropyLoss()# 计算损失值

outputs = model(inputs)

loss = loss_fn(outputs, labels)# 计算缩放因子

scale_factor =