爬虫入门到进阶(七)

scrapy初识

文章目录

- scrapy初识

- @[toc]

- 1.scrapy安装与环境依赖

- 2.创建项目

- 3.项目目录介绍

- 4.scrapy框架介绍: 5大核心组件与数据流向

- 6.scrapy爬取校花网人名与图片下载链接

文章目录

- scrapy初识

- @[toc]

- 1.scrapy安装与环境依赖

- 2.创建项目

- 3.项目目录介绍

- 4.scrapy框架介绍: 5大核心组件与数据流向

- 6.scrapy爬取校花网人名与图片下载链接

1.scrapy安装与环境依赖

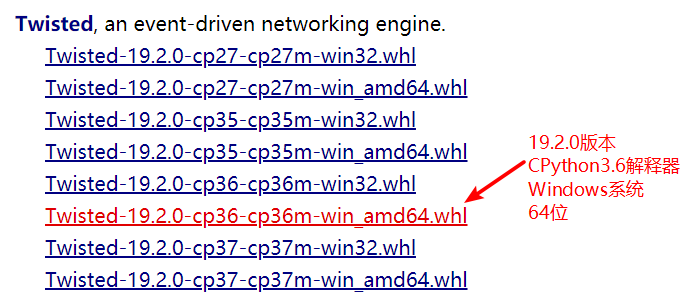

# 1.在安装scrapy前需要安装好相应的依赖库, 再安装scrapy, 具体安装步骤如下:(1).安装lxml库: pip install lxml(2).安装wheel: pip install wheel(3).安装twisted: pip install twisted文件路径(twisted需下载后本地安装,下载地址:http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted)(版本选择如下图,版本后面有解释,请根据自己实际选择)(4).安装pywin32: pip install pywin32(注意:以上安装步骤一定要确保每一步安装都成功,没有报错信息,如有报错自行百度解决)(5).安装scrapy: pip install scrapy(注意:以上安装步骤一定要确保每一步安装都成功,没有报错信息,如有报错自行百度解决)(6).成功验证:在cmd命令行输入scrapy,显示Scrapy1.6.0-no active project,证明安装成功

2.创建项目

1.手动创建一个目录test

2.在test文件夹下创建爬虫项目为spiderpro: scrapy startproject spiderpro

3.进入项目文件夹: cd spiderpro

4.创建爬虫文件: scrapy genspider 爬虫名 域名

3.项目目录介绍

spiderprospiderpro # 项目目录__init__spiders:爬虫文件目录__init__tests.py:爬虫文件items.py:定义爬取数据持久化的数据结构middlewares.py:定义中间件pipelines.py:管道,持久化存储相关settings.py:配置文件venv:虚拟环境目录scrapy.cfg: scrapy项目配置文件

说明:

(1).spiders:其内包含一个个Spider的实现, 每个Spider是一个单独的文件

(2).items.py:它定义了Item数据结构, 爬取到的数据存储为哪些字段

(3).pipelines.py:它定义Item Pipeline的实现

(4).settings.py:项目的全局配置

(5).middlewares.py:定义中间件, 包括爬虫中间件和下载中间件

(6).scrapy.cfg:它是scrapy项目的配置文件, 其内定义了项目的配置路径, 部署相关的信息等

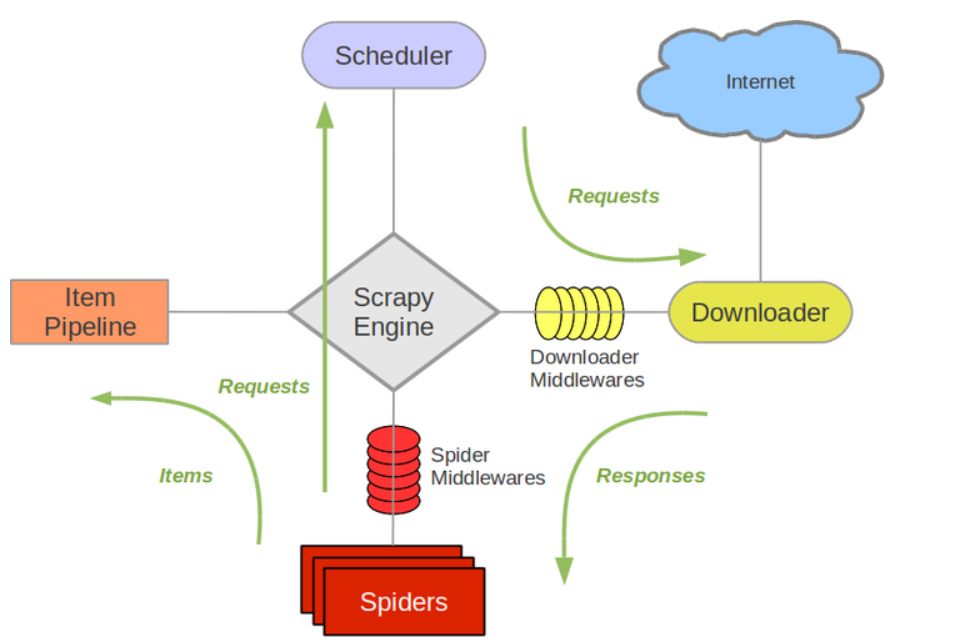

4.scrapy框架介绍: 5大核心组件与数据流向

(1).架构:Scrapy Engine: 这是引擎,负责Spiders、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等等!Scheduler(调度器): 它负责接受引擎发送过来的requests请求,并按照一定的方式进行整理排列,入队、并等待Scrapy Engine(引擎)来请求时,交给引擎。Downloader(下载器):负责下载Scrapy Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Scrapy Engine(引擎),由引擎交给Spiders来处理,Spiders:它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器),Item Pipeline:它负责处理Spiders中获取到的Item,并进行处理,比如去重,持久化存储(存数据库,写入文件,总之就是保存数据用的)Downloader Middlewares(下载中间件):你可以当作是一个可以自定义扩展下载功能的组件Spider Middlewares(Spider中间件):你可以理解为是一个可以自定扩展和操作引擎和Spiders中间‘通信‘的功能组件(比如进入Spiders的Responses;和从Spiders出去的Requests)

(2).工作流:1.spider将请求发送给引擎, 引擎将request发送给调度器进行请求调度2.调度器把接下来要请求的request发送给引擎, 引擎传递给下载器, 中间会途径下载中间件3.下载携带request访问服务器, 并将爬取内容response返回给引擎, 引擎将response返回给spider4.spider将response传递给自己的parse进行数据解析处理及构建item一系列的工作, 最后将item返回给引擎, 引擎传递个pipeline5.pipe获取到item后进行数据持久化6.以上过程不断循环直至爬虫程序终止

5.使用scrapy框架爬取糗百

# 需求: 爬取糗事百科热门板块,每一条的标题,好笑,评论条数及作者信息,解析爬取的信息数据,定制item数据存储结构,最终将数据存储于MongoDB数据库中.

# 创建项目:

scrapy startproject qsbk # 创建项目

cd qsbk # 切换到项目目录

scrapy genspider qsbk_hot www.qiushibaike.com # 创建爬虫文件, qsbk_hot为爬虫名, www...com为爬取范围

# item文件定义数据存储的字段:

import scrapy

class QsbkItem(scrapy.Item):title = scrapy.Field() # 标题lau = scrapy.Field() # 好笑数comment = scrapy.Field() # 评论数auth = scrapy.Field() # 作者

# spider文件中定义解析数据的方法

class QsbkHotSpider(scrapy.Spider):name ='qsbk_hot'# allowed_domains = ['www.qiushibaike.com'] # 无用, 可注释掉start_urls =['http://www.qiushibaike.com/']# 思路:一条热点数据在前端中对应一个li标签, 将一页中的所有li标签取出, 再进一步操作def parse(self, response):li_list = response.selector.xpath('//div[@class="recommend-article"]/ul/li')# 循环li标签组成的列表, 先实例化item, 再取需要的字段, 并该item对象的相应属性赋值for li in li_list:# 实例化item对象item =QsbkItem()# 解析获取title(标题), lau(好笑数), comment(评论数), auth(作者)等信息title = li.xpath('./div[@class="recmd-right"]/a/text()').extract_first()lau = li.xpath('./div[@class="recmd-right"]/div[@class="recmd-detail clearfix"]/div/span[1]/text()').extract_first()comment = li.xpath('./div[@class="recmd-right"]/div[@class="recmd-detail clearfix"]/div/span[4]/text()').extract_first()auth = li.xpath('./div[@class="recmd-right"]/div[@class="recmd-detail clearfix"]/a/span/text()').extract_first()# 因为部分热点数据还没有评论和好笑数, 所以需对数据进行处理if not lau:lau =Noneif not comment:comment =None# 将字段的值存储在item的属性中item["title"]= titleitem["lau"]= lauitem["comment"]= commentitem["auth"]= auth# 返回item, 框架会自动将item传送至pipeline中的指定类yield item

# 在pipeline中定义管道类进行数据的存储

import pymongoclassQsbkPipeline(object):# 连接MongoDB数据库conn = pymongo.MongoClient("localhost", 27017)db = conn.qiubaitable = db.qb_hotdef process_item(self, item, spider):# 向数据库中出入数据self.table.insert(dict(item))# 此处return item是为了下一个管道类能够接收到item进行存储return itemdef close_spider(self):# 关闭数据库连接self.conn.close()

# 此示例中配置文件中的配置的项, 注意是不是全部的配置, 是针对该项目增加或修改的配置项# 忽略robots协议

ROBOTSTXT_OBEY =False# UA伪装

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/76.0.3809.87 Safari/537.36'# 管道类的注册配置

ITEM_PIPELINES ={

'qsbk.pipelines.QsbkPipeline':300,

}

6.scrapy爬取校花网人名与图片下载链接

# 需求: 爬取校花网大学校花的默认的第一页的所有图片src和人名, 并通过管道存入mongodb数据库

# 创建项目:

scrapy startproject xiaohuaspider # 创建项目

cd xiaohuaspider # 切换到项目目录

scrapy genspider hua www.baidu.com # 创建爬虫文件, hua为爬虫名, www.baidu.com为爬取范围

# 创建item类, 用于存储解析出的数据

import scrapy

class XiaohuaspiderItem(scrapy.Item):name = scrapy.Field()src = scrapy.Field()

# spider中定义爬取的行为与解析数据的操作

import scrapy

from ..items import XiaohuaspiderItemclass HuaSpider(scrapy.Spider):name = 'hua'# allowed_domains = ['www.baidu.com']start_urls = ['http://www.xiaohuar.com/hua/']def parse(self, response):div_list = response.xpath('//div[@class="img"]')for div in div_list:item = XiaohuaspiderItem()name = div.xpath('.//span/text()').extract_first()src = div.xpath('./a/img/@src').extract_first()item["name"] = nameitem["src"] = srcyield item

# itemPipeline编码, 持久化数据到本地

import pymongoclass XiaohuaspiderPipeline(object):conn = pymongo.MongoClient('localhost', 27017)db = conn.xiaohuatable = db.huadef process_item(self, item, spider):self.table.insert(dict(item))return itemdef close_spider(self, spider):self.conn.close()

# 配置项:

# UA伪装:

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/76.0.3809.87 Safari/537.36'# 忽略robots协议:

ROBOTSTXT_OBEY = False# 开启管道类

ITEM_PIPELINES = {'xiaohuaspider.pipelines.XiaohuaspiderPipeline': 300,

}