大语言模型值ollama使用(1)

ollama为本地调用大语言模型提供了便捷的方式。下面列举如何在windows系统中快捷调用ollama。

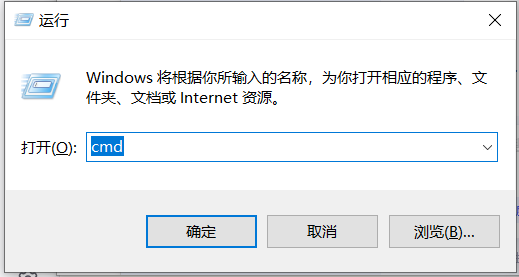

win+R打开运行框,输入cmd

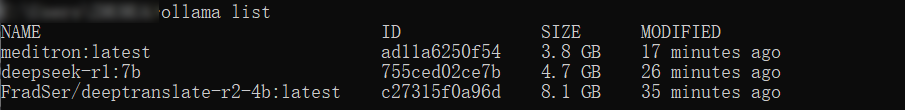

1、输入ollama list

显示已下载模型

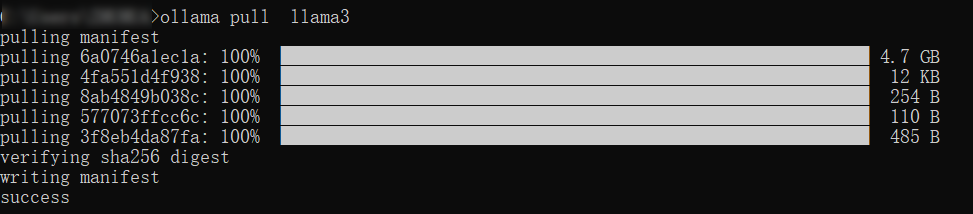

2、输入ollama pull llama3

下载llama3模型

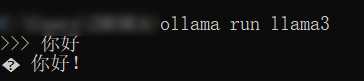

3、 输入 ollama run llama3

运行模型

4、其他

ollama list 显示已下载的模型

ollama show llama3 展示模型信息

ollama rm llama3 删除模型

5、设置模型地址

setx OLLAMA_MODELS "D:\自定义路径\ollama-models"